Optimales Passthrough: So will es Meta hinkriegen

Gutes VR-Passthrough ist eine große technische Herausforderung. Forschende der Reality Labs zeigen eine neue, KI-basierte Lösung.

Inhalt

Headsets wie Varjo XR-3, Quest Pro, Lynx R-1 und Apples kommende Techbrille werden in den nächsten Jahren die beste Art sein, Augmented Reality zu erleben.

Im Gegensatz zu herkömmlichen AR-Headsets mit transparenter Optik wie Hololens 2 und Magic Leap 2, die AR-Elemente über ein Wellenleiterglas direkt ins Auge projizieren, filmen die obigen Headsets die physische Umgebung mithilfe nach außen gerichteter Kameras und stellen sie anschließend auf den opaken Displays dar. Dort können sie anschließend beliebig um AR-Elemente erweitert werden.

___STEADY_PAYWALL___Künstliche Blicksynthese: Ein großes Problem

Diese Passthrough genannte Technik hat große Vorteile gegenüber klassischer AR-Optik, aber auch ihre eigenen Probleme. Die Herausforderung besteht darin, die physische Umgebung mithilfe der Sensordaten so zu rekonstruieren, als sähe sie die Headset-tragende Person mit ihren eigenen Augen. Das ist eine enorm schwierige Aufgabe.

Auflösung, Farbtreue, Tiefendarstellung und Perspektive: All das muss mit dem natürlichen Seheindruck übereinstimmen und sich mit einer möglichst geringen Latenz oder zeitlichen Verzögerung verändern, wenn man den Kopf bewegt.

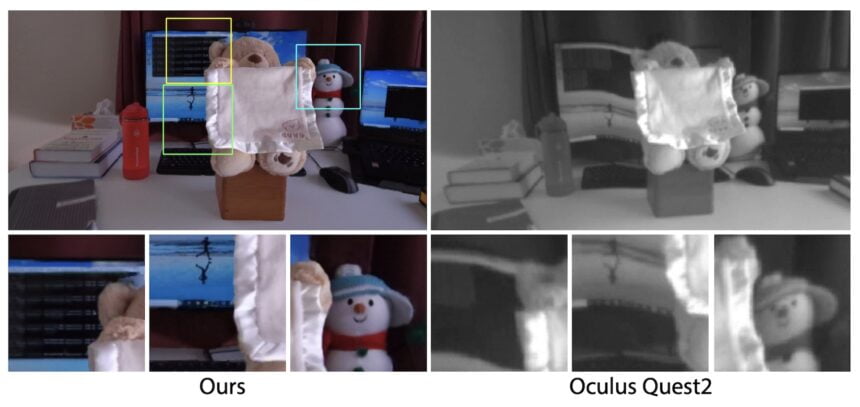

NeuralPassthrough und Passthrough+ der Meta Quest 2 im Bildvergleich. | Bild: Reality Labs Research

Gerade die Perspektive stellt die Technik vor große Probleme, da die Positionen der Kameras nicht exakt den Augenpositionen entsprechen. Diese perspektivische Verschiebung kann Unwohlsein und visuelle Artefakte verursachen. Letzteres, weil Seiten eines nahen Gegenstands oder der Hände in der Kamerasicht verdeckt sein können, während sie das in der natürlichen Sicht nicht wären.

Der aktuelle Stand der Passthrough-Technik lässt sich mit der Meta Quest 2 feststellen: Die Darstellung der Umgebung ist schwarzweiß, grobkörnig und verzerrt, gerade bei Objekten, die man nahe vors Gesicht hält.

Die oben genannten Geräte werden schon bald bessere Resultate liefern, da die Sensortechnik für die Passthrough-Technik optimiert ist. Ein perfektes Abbild der physischen Umgebung sollte man allerdings nicht erwarten, weil viele der grundlegenden Probleme (siehe oben) noch nicht gelöst sind.

KI-Rekonstruktion liefert hochwertige Ergebnisse

Im August präsentierten Meta-Forschende im Rahmen der Siggraphh 2022 eine Reihe technischer VR-Innovationen, darunter eine neue Passthrough-Methode, die die Sichtperspektive mittels künstlicher neuronaler Netze rekonstruiert. Die Technik hört auf den Namen NeuralPasstrough.

"Wir nutzen, im Gegensatz [zu früheren Ansätzen], jüngste Fortschritte im Deep Learning, um Passthrough als ein bildbasiertes neuronales Rendering-Problem zu lösen", heißt es in der Forschungsarbeit.

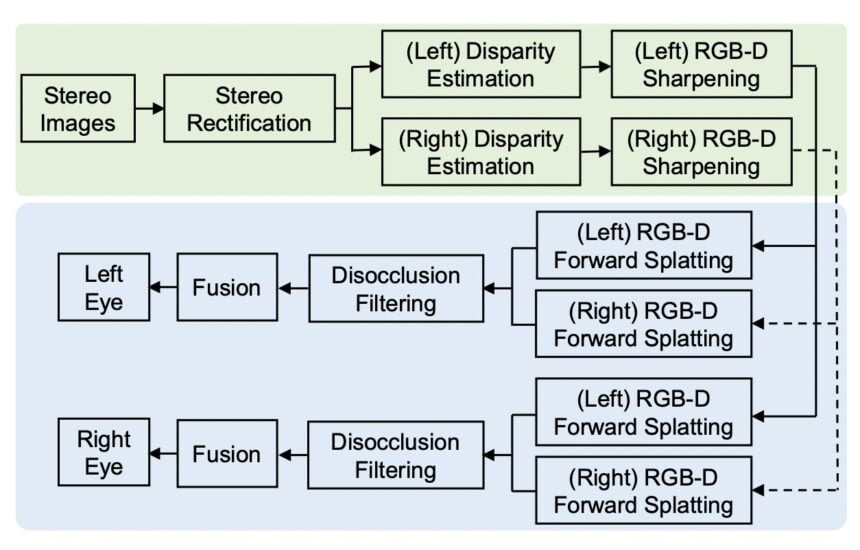

Passthrough ist nicht gleich Passthrough (Deutsch: Durchleitung). Das Stereobildmaterial der Kameras durchläuft eine Vielzahl KI-gesteuerter Anpassungen, bevor es an die Displays ausgegeben wird | Bild: Xiao et al. / Reality Labs Research

Der entwickelte KI-Algorithmus schätzt zum einen die Tiefe des Raums und der darin befindlichen Objekte, zum anderen rekonstruiert er einen künstlichen Blickpunkt, der denen der Augen entspricht.

Trainiert wurde das KI-Modell anhand von synthetischen Datensätzen: Sequenzen von Bildern, die 80 räumliche Szenen aus unterschiedlichen Blickperspektiven zeigen. Das daraus resultierende künstliche neuronale Netz ist flexibel und kann auf unterschiedliche Kameras und Augenabstände angewandt werden.

MIXED.de ohne Werbebanner

Zugriff auf mehr als 9.000 Artikel

Kündigung jederzeit online möglich

Keine zeitnahe Lösung – zumindest für autarke Headsets

Die Resultate sind vielversprechend. Im Vergleich zur Meta Quest 2 und anderen Passthrough-Methoden liefert NeuralPassthrough eine bessere Bildqualität und erfüllt die Anforderungen für eine perspektivisch korrekte stereoskopische Blicksynthese, wie folgendes Video zeigt.

Dennoch hat die Technik gewisse Einschränkungen. So hängt die Qualität des Resultats stark davon ab, wie genau die KI-Raumschätzung arbeitet. Tiefensensoren könnten das Ergebnis in Zukunft verbessern. Eine weitere Herausforderung sind perspektivenabhängige Reflexionen auf Objekten, die das KI-Modell nicht rekonstruieren kann. Die Folge sind wiederum Artefakte.

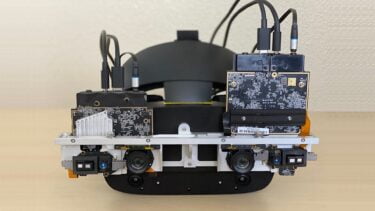

Ein weiteres Problem ist die benötigte Rechenleistung: Der eigens für Forschungszwecke gebaute Prototyp (siehe Titelbild) wird von einem Desktop-Computer befeuert, in dem ein Intel Xeon W-2155 und zwei Nvidia Titan V arbeiten, eine Highend-Grafikkarte pro Auge.

Das Resultat ist ein Passthrough-Bild, das mit 1.280 mal 720 Bildpunkten auflöst und eine Latenz von 32 Millisekunden aufweist. Für hochwertiges Passthrough ist das eine zu geringe Auflösung mit einer zu starken Latenz.

"Um ein überzeugendes VR-Passthrough zu liefern, muss die Branche erhebliche Fortschritte bei der Bildqualität machen und gleichzeitig die strengen Anforderungen in Bereichen wie Echtzeitberechnung, Stereoskopie und Sichtfeld erfüllen", heißt es im Fazit. "Wenn man dann noch die Einschränkungen mobiler Prozessoren hinzunimmt, haben wir wirklich noch einen langen Weg vor uns."

Hinweis: Links auf Online-Shops in Artikeln können sogenannte Affiliate-Links sein. Wenn ihr über diesen Link einkauft, erhält MIXED.de vom Anbieter eine Provision. Für euch verändert sich der Preis nicht.