Apple AR-Brille: Steuerung per Mikrogestik?

Wie bedient man die AR-Brillen der Zukunft? Apple könnte wie Facebook auf Mikrogesten setzen. Darauf deutet ein Patent sowie ein neues Feature für die Apple Watch.

Vergangene Woche stellte Apple eine Reihe neuer Features für barrierefreie Interaktion vor, darunter Assistive Touch für die Apple Watch. Dank dieser Funktion kann man das Wearable ohne Berühren des Bildschirmes bedienen. Die Apple Watch erfasst durch integrierte Sensoren feinste Muskelaktivitäten und übersetzt sie mithilfe maschinellen Lernens in Computerbefehle.

In einem Video demonstriert Apple, wie Assistive Touch funktioniert: Ballt man eine Faust, oder indem man Daumen und Zeigefinger zusammenführt, kann man Menüs aufrufen, Eingaben bestätigen, Anrufe entgegennehmen und einen Cursor aktivieren. Die andere Hand wird nicht benötigt.

___STEADY_PAYWALL___Auch Facebook forscht an Mikrogestik

Der nächste Schritt liegt nahe: Durch Weiterentwicklung der Sensortechnik und eine feinere Erfassung der Muskelaktivität wären sogenannte Mikrogesten als Eingabemethode denkbar. Damit ließe sich die Apple Watch oder eine kommende Apple Glass mit kleinsten Bewegungen der Finger steuern.

AR-Brillen fehlt noch immer ein ideales Interface: Spezielle Controller oder andere Hardware sind nicht optimal, da man sie mit sich tragen muss und verlieren kann. Sprachbefehle sind ein weiterer Kandidat, können jedoch von der Umgebung mitgehört werden. Mikrogesten haben den Vorteil, dass sie unauffällig, weitgehend ermüdungsfrei und leicht zu erlernen sind.

Im März stellte Facebook seine Forschung an einem neuralen Armband vor, das Steuerung per Mikrogestik ermöglicht. Es interpretiert Hirnsignale direkt am Handgelenk und verwandelt sie in Eingaben. Mit der Technologie soll es möglich werden, Computerbefehle allein durch Gedankenkraft auszulösen.

Facebook bezeichnet das Armband als bislang vielversprechendstes AR-Interface und festen Teil von Facebooks AR-Zukunft. Laut Gerüchten soll schon 2022 eine Facebook-Smartwatch mit dem neuralem Interface auf den Markt kommen.

Apple Watch mit EMG-Sensoren?

Apple gilt neben Facebook als größter Investor in AR-Technologie. Das Assistive Touch-Feature legt nahe, dass Apple bereits in Richtung Mikrogesten-Input forscht.

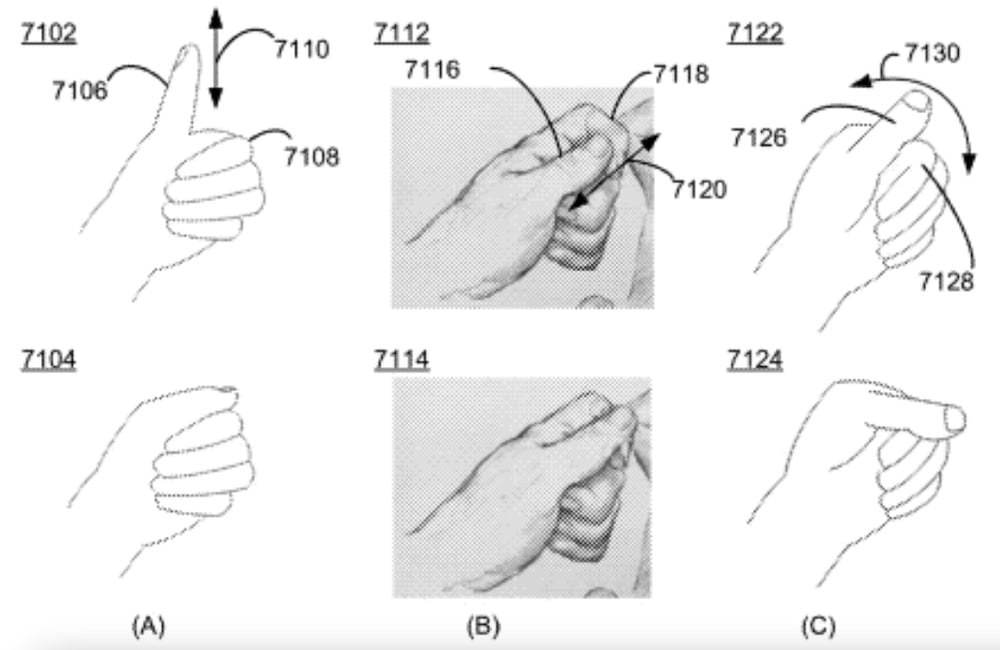

Ein Patentantrag vom Herbst 2020 liefert einen zusätzlichen Beleg: Darin wird eine Eingabemethode für Augmented Reality beschrieben, bei dem feinste Bewegung des Daumens von Kameras oder anderen Sensoren erkannt und in Computerbefehle übersetzt werden. Folgende Abbildung zeigt, wie die Mikrogesten-Steuerung funktionieren könnte.

MIXED.de ohne Werbebanner

Zugriff auf mehr als 9.000 Artikel

Kündigung jederzeit online möglich

AR-Steuerung mit Daumenbewegungen? Eine Abbildung aus Apple Mikrogesten-Patent. | Bild: Apple

Der Ansatz erinnert an Facebook (siehe Video oben), nur die verwendete Sensortechnik ist anders. Während Facebook neurale Inputs nutzt, ist im Apple-Patent nicht ausdrücklich von der Verarbeitung elektrischer Hirnsignale die Rede.

Es dürfte jedoch ein Leichtes für Apple sein, EMG-Sensoren in die Apple Watch einzubauen. Gerüchte aus 2019 zeigen, dass Apple zumindest darüber nachgedacht hat, entsprechende Sensoren in die Apple Watch einzubauen - sofern nicht der Datenschutz dagegen spricht. Schließlich werden hierbei Hirninformationen abgefangen und maschinell ausgewertet.

Die Vorteile der Eingabemethode sind Apple jedenfalls bekannt. Mikrogesten seien diskret, unauffällig und eigneten sich für Interaktionen, die in der Öffentlichkeit stattfinden, heißt es im Patent.

Quelle und Titelbild: Apple, Freepatentsonline

Weiterlesen über neurale Interfaces:

- KI-Hirninterface: Versuchsperson schreibt 90 Zeichen pro Minute per Gedankenkraft

- Facebook: Hirn-Interfaces "in 3 bis 5 Jahren" marktreif

- Nextmind: Hirn-Interface mit KI-Unterstützung startet

Hinweis: Links auf Online-Shops in Artikeln können sogenannte Affiliate-Links sein. Wenn ihr über diesen Link einkauft, erhält MIXED.de vom Anbieter eine Provision. Für euch verändert sich der Preis nicht.