Next-Gen-VR: Meta zeigt neue VR-Prototypen

Meta hat auf dem eigenen Blog einen ausführlichen Artikel zum Thema mit weiteren Details, Bildern und Videos veröffentlicht. Der Artikel liegt in englischer und deutscher Sprache vor.

Ein erstes Hands-on mit den Prototypen liefert der Youtube-Kanal Tested. Ich habe die Eindrücke in einem separaten Artikel zusammengefasst.

Meta gibt wieder Einblick in die eigenen Forschungslabore und zeigt, in welche Richtung sich VR-Displays in den nächsten Jahren entwickeln könnten.

Im vergangenen Herbst richtete Mark Zuckerberg sein Unternehmen neu aus: aus Facebook wurde Meta, mit dem Ziel, die Grundlagen des Metaverse zu legen. Zuckerberg zeigte eine Vision der Zukunft, in der sich Menschen in virtuellen Welten treffen, spielen und arbeiten.

Heutige VR-Technik wird dieser Sci-Fi-Vorstellung nicht gerecht. Das Kernstück einer VR-Brille, das Display, hat sich in den letzten zehn Jahren kaum weiterentwickelt und ist noch immer recht primitiv: zwei relativ tief auflösende Smartphone-Bildschirme, die hinter eine Linse geschaltet sind und dem Auge eine 3D-Welt vorgaukeln.

Um das volle visuelle Potenzial der Virtual Reality abzurufen, braucht es mehr: eine neue Art von VR-Display, das der Leistungsfähigkeit des menschlichen Sehvermögens gerecht wird.

Inhalt

VR-Displays: Jenseits herkömmlicher Bildschirme

Meta arbeitet seit 2015 an neuartigen VR-Displays und gibt nun den bislang tiefsten Einblick in die eigene Display-Forschung: von frühen Prototypen über VR-Displays der nächsten Generation bis hin zu noch unverwirklichten futuristischen Konzepten.

Die Forschung zeigt, in welche Richtung sich Virtual Reality in den nächsten Jahren entwickeln könnte und dass die dazugehörige Display-Technologie weit über die herkömmlicher 2D-Bildschirme hinausgeht.

"Es handelt sich um eine wirklich neue Technologie", sagt Mark Zuckerberg. "Wir entwickeln nicht nur die Bildschirme weiter, die wir schon seit Jahrzehnten von Telefonen, Fernsehern oder Computermonitoren kennen und die es bereits gibt. Wir müssen neue Wege beschreiten und erforschen, wie physische Systeme zusammenarbeiten und wie unser visuelles System die Welt wahrnimmt."

Der visuelle Turing-Test: Vier Herausforderungen

Das Ziel ist die Entwicklung eines VR-Displays, das den visuellen Turing-Test besteht und in einem sowohl schlanken als auch leichten VR-Headset Platz findet.

"1950 formulierte Alan Turing den Turing-Test, um herauszufinden, ob sich ein Computer glaubhaft als Mensch ausgeben könne. Mit der Methode des visuellen Turing-Tests wird bewertet, ob das, was in VR dargestellt wird, von der realen Welt unterschieden werden kann", erklärt Metas Chefwissenschaftler Michael Abrash. Aktuell sei keine VR-Technologie in der Lage, diesen Test zu bestehen.

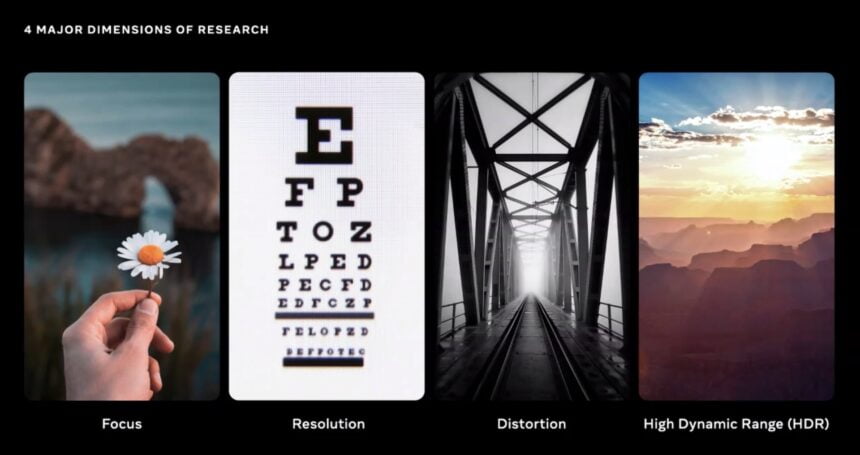

Die vier großen Herausforderungen bei der Entwicklung von VR-Displays. | Bild: Meta

Das auf Display-Entwicklung spezialisierte Team der Abteilung Display Systems Research (DSR) hat vier Eigenschaften definiert, die VR-Displays erfüllen müssen, um den visuellen Turing-Test zu bestehen. Sie sollten

- ein natürliches Fokussieren virtueller Objekte ermöglichen (siehe Vergence-Accommodation-Konflikt),

- eine Auflösung erreichen, die dem Sehvermögen der Retina entspricht,

- durch Linsen bedingte optische Verzerrungen ausgleichen und

- HDR unterstützen, also ein weitaus größeres Farb- und Kontrastspektrum abdecken, als es heutige VR-Displays tun.

Warum ist visueller Realismus wichtig?

Laut Mark Zuckerberg eröffnet ein VR-Display, das all diese Bedingungen erfüllt und dem menschlichen Sehvermögen angepasst ist, neue Möglichkeiten: es verstärke zum einen soziale Präsenz, also das Gefühl der Anwesenheit anderer Menschen im gleichen virtuellen Raum, zum anderen erlaube es eine "neue Generation visueller Erlebnisse", die neue Ausdrucksmöglichkeiten bereitstellt und damit große kulturelle Tragweite hat.

"Wir werden Erfahrungen machen können, die wir sonst niemals erleben könnten. Und genau dieses Gefühl einer umfassenden, vielfältigen Erfahrung ist es, weshalb Realismus so wichtig ist", sagt Zuckerberg.

Einige der genannten technischen Herausforderungen seien schon gelöst, während es bei andere noch viel zu tun gebe. Aber auch abseits der Display-Technologie sind noch viele Durchbrüche nötig. "Die Entwicklung dieser Geräte ist ein umfassender Prozess, bei dem es nicht nur auf Displays ankommt, sondern auch auf hochmoderne Software, Chips, Sensoren und sonstige Hardware, die reibungslos miteinander funktionieren müssen", so Zuckerberg.

Im aktuellen Forschungseinblick gehe es nur um das "letzte Glied in der Kette": Display-Systeme. Das DSR-Team präsentiert in diesem Rahmen eine Reihe von Prototypen vor, die teils bekannt, teils neu sind und Versuche darstellen, die oben genannten Herausforderungen zu meistern.

Wann genau diese Display-Technologien in kommerzielle Headsets Eingang finden, sagt Meta nicht. Zuckerberg nennt als groben Zeitrahmen "kommenden Jahre".

Half-Dome: Prototyp mit varifokalem Display

Die Half-Dome-Prototypen zeigte Meta schon 2018 und 2019.

Das Ziel dieser Forschung besteht in der Entwicklung eines varifokalen Display-Systems, das in handelsüblichen VR-Headsets verbaut werden kann. Varifokal bedeutet, dass die Träger:innen virtuelle Objekte so fokussieren können als seien sie Teil der physischen Umgebung.

Das ist keine Selbstverständlichkeit, da VR-Headsets bis heute eine einzige, fixe Fokusebene haben, was den menschlichen Sehapparat behindern kann. Zu den möglichen Folgen gehören unscharfes Sehen, Augenschmerzen und sogar Übelkeit. Der sogenannte Vergence-Accommodation-Konflikt (Erklärung) verhindert eine längere Verweildauer in Virtual Reality oder macht sie zumindest anstrengend für die Augen. Entsprechend dringlich ist eine Lösung dieses Problems.

Die bisherigen Half-Dome-Prototypen. | Bild: Meta

Metas erster varifokaler Prototyp wurde 2015 gebaut und war sehr wuchtig. 2017 entwickelte das Team Half-Dome Zero, ein Gerät, das den Formfaktor einer Oculus Rift besitzt und mit PC-VR-Spielen funktioniert. Mit diesem Headset führte Meta eine interne Studie durch, die die immensen Vorteile eines varifokalen Display-Systems erwies: Die Teilnehmer:innen bevorzugten die künstliche Fokussierung, weil sie zu einem wesentlich angenehmeren und scharfen Seherlebnis führte sowie das Lesen von Texten und Identifizieren kleiner Objekte erleichterte.

Solche Effekte sind mit heutigen VR-Brillen noch nicht möglich: Ein Objekt im unmittelbaren Vordergrund wird beim Fokussieren scharf, während der Hintergrund unscharf wird – und umgekehrt. | Bild: Meta

Mit Half-Dome 3 (2019) gelang dem Team ein wichtiger Durchbruch: Der jüngste Prototyp setzt auf sogenannte Flüssigkristallinsen, die die beweglichen Teile früherer Prototypen überflüssig machen und die Fokusebenen mittels elektrischer Zustände einstellen. Ein weiterer Vorteil dieser Technik ist der wesentlich schmalere Formfaktor, den sie ermöglicht.

Leider zeigte Meta keine neueren Half-Dome-Prototypen. Das letzte bekannte Gerät ist Half-Dome 3.

Butterscotch: VR-Prototyp mit "Retina-Auflösung"

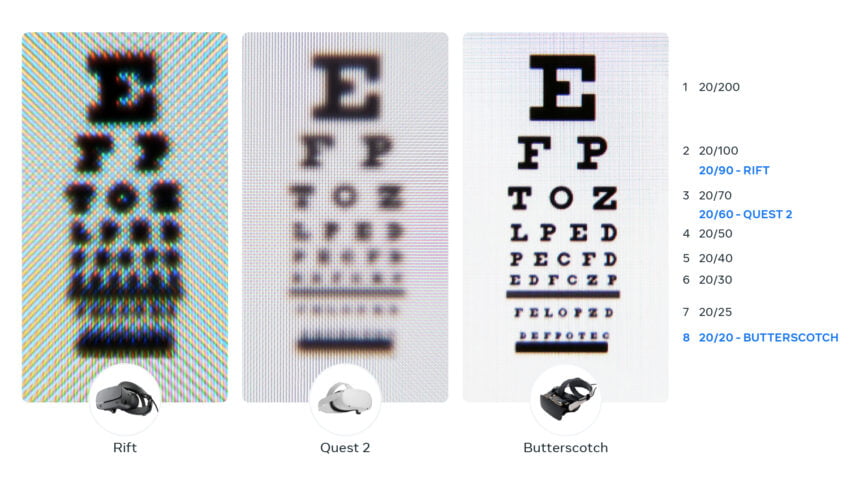

Eine weitere wichtige Bedingung für visuellen Realismus ist die Auflösung.

Meta schätzt, dass VR-Headsets eine 8K-Auflösung pro Auge und eine Pixeldichte von 60 PPD erreichen müssen, um das menschliche Sehvermögen auszutricksen und ein täuschend echtes Abbild der Realität zu schaffen. Zum Vergleich: Heutige VR-Brillen wie die Meta Quest 2 bewegen sich im Bereich einer 2K-Auflösung und 20 PPD.

Der Butterscotch-Prototyp samt wegführender PC-VR-Kabel. Bild: Meta

Neben der Zahl der Pixel muss auch deren Qualität verbessert werden. "Momentan haben VR-Headsets einen deutlich niedrigeren Farbumfang, eine geringere Helligkeit und einen geringeren Kontrast als Laptops, Fernseher oder Smartphones", erklärt Michael Abrash. "Was die feineren Details und die naturgetreue Darstellung angeht, kann VR also nicht wirklich das Niveau erreichen, das wir von unseren 2D-Displays gewohnt sind."

Meta hat mehrere Retina-Prototypen entwickelt. Butterscotch ist der neueste dieser Klasse und der erste Retina-Prototyp, den Meta der Öffentlichkeit präsentiert. Er bietet laut Abrash eine Pixeldichte von 55 PPD, was einer zweieinhalb Mal so hohen Auflösung wie die der Meta Quest 2 entspricht. Um diese Auflösung zu erreichen, entwickelte das Team eine neue hybride Linse und reduzierte das gewohnte Sichtfeld um die Hälfte.

Vergleich der Darstellungsschärfe verschiedener VR-Brillen. | Bild: Meta

Das ist einer der Gründe, weshalb das Gerät noch nicht produktionsreif ist. "Es ist schwer, es ist sperrig, aber es zeigt sehr gut, welchen Unterschied eine höhere Auflösung für das VR-Erlebnis macht", sagt Abrash. Selbst Details auf Blättern eines Baumes seien damit erkennbar.

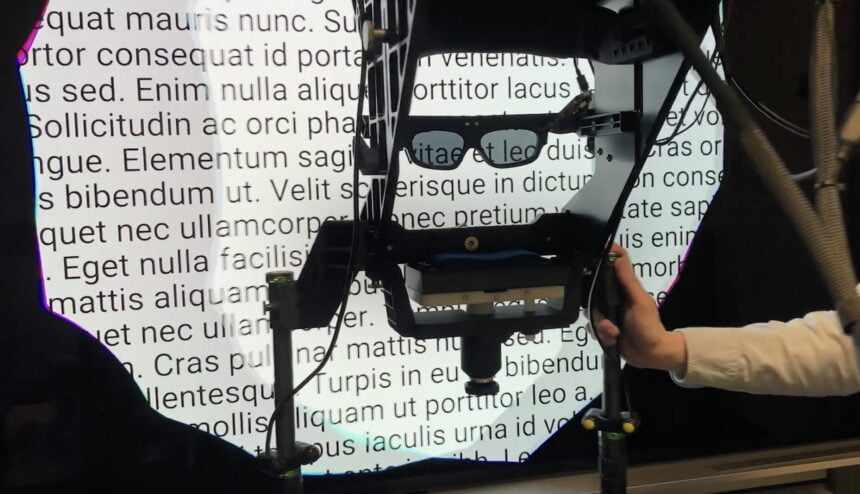

Gegen optische Verzerrung: Ein Simulator erlaubt schnelles Prototyping

Ein weiteres Hindernis für das Bestehen des visuellen Turing-Tests ist die Verzerrung, die durch die optische Brechung des Lichts entsteht. Bei Meta Quest 2 wird diese durch Software korrigiert.

MIXED.de ohne Werbebanner

Zugriff auf mehr als 9.000 Artikel

Kündigung jederzeit online möglich

"Für den Moment erreichen wir damit eine ziemlich gute Annäherung, aber das Ergebnis ist oft nicht ideal, weil sich die Verzerrung eines virtuellen Bildes ändert, wenn das Auge in verschiedene Richtungen sieht und sich dabei bewegt", erklärt Abrash. Eine perfekte Verzerrungskorrektur wäre dynamisch und passte sich den Augenbewegungen in Echtzeit an.

Diese Vorrichtung erlaubt Rapid Prototyping von Linsen und Entzerrungsalgorithmen. Bild: Meta

Dem Team gelang in diesem Bereich ein methodischer Durchbruch: Es entwickelte eine Vorrichtung, mit der sich Verzerrungskorrekturen binnen Minuten statt wie bisher Monaten simulieren und auswerten lassen.

"Das Team hat einen Verzerrungssimulator gebaut, der mit virtuellen Objekten und Eye-Tracking die Verzerrung nachbildet, die man bei einem Headset bei einer bestimmten Optik-Bauweise sehen würde und sie mithilfe von 3D-Fernsehtechnologie darstellt", sagt Abrash. "So kann das Team verschiedene Optik-Bauweisen und Algorithmen zur Verzerrungskorrektur untersuchen, ohne ein echtes Headset bauen zu müssen."

Diese Forschung wird in die Entwicklung kommender Linsen und Korrekturalgorithmen fließen.

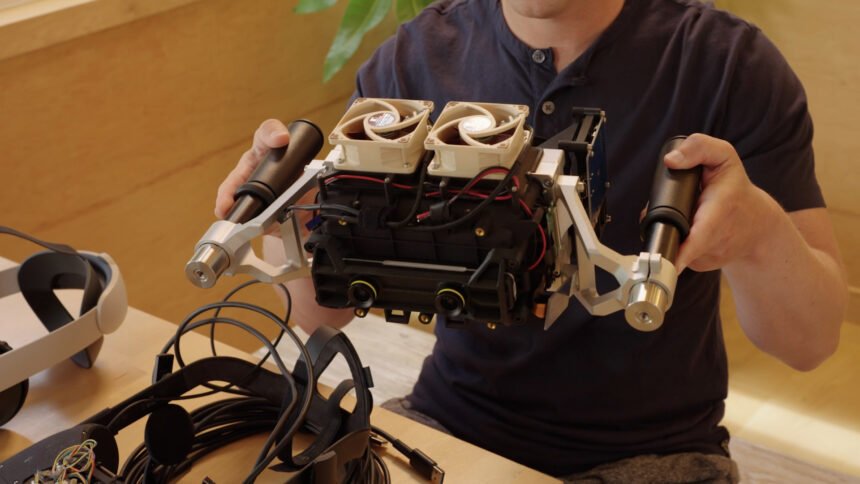

Starburst: VR-Prototyp mit HDR-Bildschirm

Die letzte große Herausforderung ist die Entwicklung eines VR-Displays, das HDR-tauglich ist. Zuckerberg misst dieser Aufgabe besonders viel Bedeutung bei und bezeichnet die HDR-Tauglichkeit als "den wohl wichtigsten Bereich" unter den bislang genannten – zumindest wenn es um visuellen Realismus geht.

"Die Erfahrung hat uns gelehrt, dass bei hellem Licht die Farben richtig leuchten und Schatten dunkel bleiben. Erst dann fühlt sich die Szene wirklich lebendig an", so Zuckerberg. "Das Problem ist, dass die Lebendigkeit aktueller Bildschirme nicht mal ansatzweise vergleichbar mit dem ist, was das Auge in der realen Welt sieht."

Nicht praktikabel, aber einzigartig bei Meta: Ein Prototyp, der 20.000 Nits unterstützt. | Bild: Meta

Die Leuchtkraft eines Displays wird in Nits gemessen. Moderne HDR-Fernseher kommen auf mehrere tausende Nits, während Quest 2 auf 100 Nits kommt.

Um die Wirkung eines HDR-Headsets zu testen, kombinierte das DSR-Team ein LC-Display mit einer starken Lampe. Das Ergebnis ist ein VR-Prototyp mit Namen Starburst, der 20.000 Nits erreicht. Dieser Grad an Helligkeit kann Lichtbedingungen in Innenräumen oder Nachtumgebungen akkurat simulieren.

Die Nachteile des ersten HDR-Prototyps sind offensichtlich: Das Gerät ist kabelgebunden und so wuchtig und schwer, dass es an zwei Griffen gehalten werden muss. "Diese erste Generation ist absolut ungeeignet für ein Produkt. Wir nutzen es aber zu Testzwecken und für weitere Untersuchungen, damit wir eine Vorstellung davon bekommen, wie sich das Erlebnis anfühlt", sagt Zuckerberg.

Holocake 2: VR-Prototyp mit ultrakompaktem Formfaktor

Fortschrittliche Display-Systeme sind nicht alles: Sie müssen auch in ein VR-Headset passen, das möglichst schlank, leicht und erschwinglich ist.

Meta zeigt einen weiteren VR-Prototyp, der Fortschritte im Bereich des Formfaktors demonstriert: Holocake 2, Metas bislang dünnster und leichtester VR-Brille.

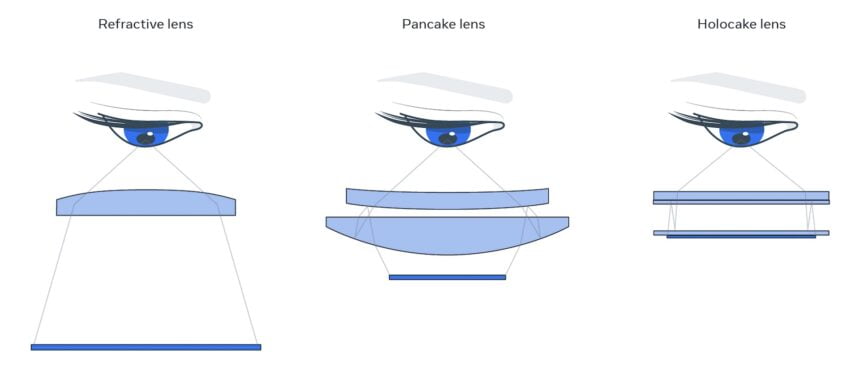

Der Name ist ein Kofferwort und leitet sich aus der eingesetzten Optik ab, die einen ultrakompakte Bauweise ermöglicht: eine bislang nicht gezeigte Kombination aus holografischer Linse und Pancake-Optik.

Mark Zuckerberg mit Holocake 2 und Lichtabschirmung. | Bild: Meta

Die holografische Linse geht auf Forschung zurück, die Meta vor zwei Jahren präsentierte. Sie ist ausgesprochen dünn im Vergleich zu herkömmlichen Linsen und emuliert im Falle von Holocake 2 eine Pancake-Linse, sodass noch mehr Raum eingespart wird.

Holocake 2 ist eine voll funktionsfähige PC-VR-Brille und bewegt sich in puncto Sichtfeld, Auflösung und Eyebox auf dem Niveau der Meta Quest 2 – mit einem deutlich dünneren Profil. Das VR-Headset ist allerdings auch kabelgebunden und hat anders als Quest 2 keine Recheneinheit und Kühler integriert, ansonsten wäre es dicker.

Klassische VR-Optik mit großem Abstand zwischen Display und Linse (links), Pancake-Optik mit stark verringertem Abstand (Mitte) und Holocake-Optik, die zusätzlich die Dicke der Linse reduziert und Pancake-Optik emuliert. | Bild: Meta

Eine weitere Besonderheit von Holocake 2 ist die Lichtquelle: Sie besteht aus Lasern statt LEDs, aus Gründen der Helligkeit und Farbtreue. Einen Nachteil hat die Lasertechnik: Sie ist längst nicht produktionsreif und in Massen herstellbar.

"Wir müssen noch viel Entwicklungsarbeit leisten und einen marktreifen Laser entwickeln, der unsere Anforderungen erfüllt: Er muss sicher, kostengünstig und effizient sein und er muss in ein schlankes VR-Headset passen", so Abrash. Sollte ein passender Laser gefunden werden, könnten VR-Displays in Sonnenbrillengröße entstehen.

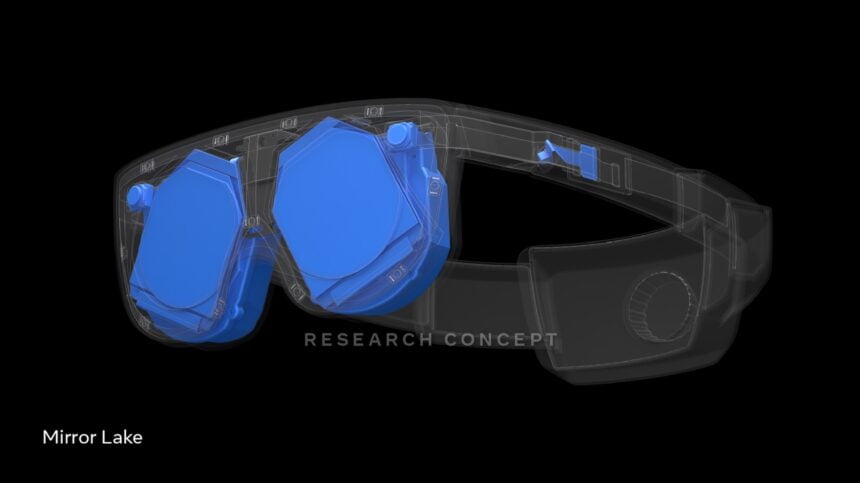

Mirror Lake: Metas Endgegner

Half-Dome, Butterscotch, Starburst und Holocake 2 demonstrieren neue Display-Systeme, die helfen sollen, den visuellen Turing-Test zu bestehen. Metas nächstes Ziel ist, all diese Technologien in einem leichten, schlanken und stromsparenden VR-Headset zu vereinen.

Der letzte Prototyp mit Namen Mirror Lake dient genau diesem Zweck. Wobei man derzeit eher von einem Forschungskonzept sprechen sollte: Meta ist es noch nicht gelungen, ein funktionsfähiges Headset dieser Art zu bauen und es zeigte auch keinen Prototyp.

Ein Rendering des geplanten Mirror-Lake-Prototyps. | Bild: Meta

Die holografische Linse des Holocake-2-Prototyps bildet das technische Fundament, da sie die Integration weiterer Technologien (varifokales Display, Multi-View-Eyetracking, Verzerrungskorrektur und anpassbare Sehstärken) in einem schlanken Skibrillen-Formfaktor ermöglicht.

Mirror Lake soll außerdem eine neue Passthrough-Technik und externe Displays bieten, die die Augen und das Gesicht der Nutzer:innen zeigt. Einen entsprechenden Prototyp präsentierte Meta vor einem knappen Jahr.

Von allen VR-Prototypen ist Mirror Lake noch am weitesten von einer Vermarktung entfernt und könnte zugunsten anderer Display-Lösungen aufgegeben werden, sofern sich diese als vielversprechender erweisen.

Nachfolgend findet ihr ein 30-minütiges Video, in dem Mark Zuckerberg und Michael Abrash eingehender über die VR-Displayforschung und deren Bedeutung für Virtual Reality sprechen.

Hinweis: Links auf Online-Shops in Artikeln können sogenannte Affiliate-Links sein. Wenn ihr über diesen Link einkauft, erhält MIXED.de vom Anbieter eine Provision. Für euch verändert sich der Preis nicht.