News der Woche: Deepfakes vs. Medienkompetenz

Rückblick in die Computerzukunft: Wer hätte es gedacht, Deepfakes funktionieren. Und jetzt?

Wenn Medienkompetenz die Antwort auf KI-Medien ist, dann haben Deepfakes schon gewonnen

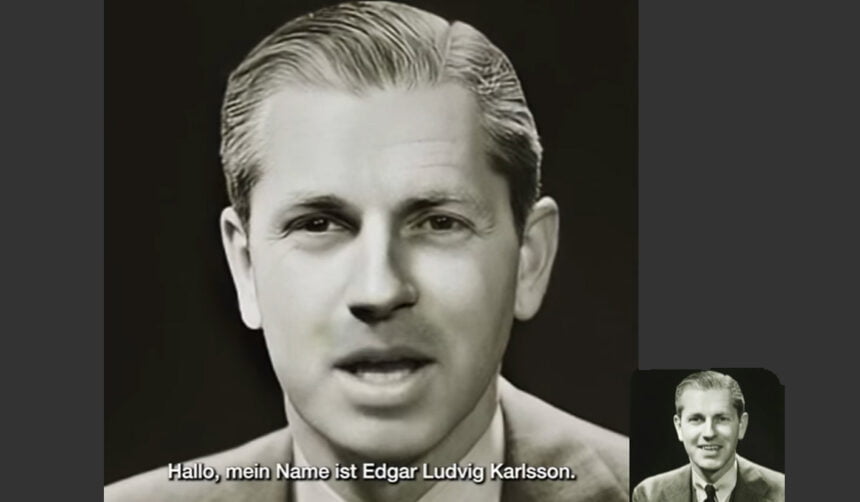

Dieser technisch veraltete Deepfake ist wirklich einfach zu entlarven. Gelingt es euch? | Bild: Deepfake/ This Person does not exist

Zwei aktuelle Studien zeigen, dass Menschen synthetische Medien - je nach Kontext auch "Deepfakes" genannt - schlecht oder kaum mehr von Originalmedien unterscheiden können. Bei einfachen Porträtbildern klappt die Unterscheidung fast gar nicht mehr.

Erst bei zunehmender Komplexität des Fakes (Video, Audio) liegen Menschen signifikant häufiger richtig als Zufall, aber in vielen Fällen dennoch falsch. Dabei verwendeten die Forschenden nicht einmal die neueste Deepfake-Technologie.

___STEADY_PAYWALL___Beide Deepfake-Studien, und nicht nur die, empfehlen, dass Menschen Medienkompetenz vermittelt werden muss, damit sie KI-Fälschungen besser erkennen können. Ich halte das für einen Trugschluss.

Wenn Menschen KI-Fakes selbst unter Idealbedingungen, also mit Fokus auf den Medieninhalt und dem Wissen, dass sie eine Fälschung aufspüren sollen, kaum erkennen können - dann wird ihnen das im hektischen Social-Media-Gewirr erst recht nicht gelingen.

Viele Fake-Fotos und -Videos im Kontext des russischen Angriffskriegs gegen die Ukraine wären anhand offensichtlicher inhaltlicher Fehler (falsche Jahreszeit, falsche Region, falsche Sprache, falsche Uniform etc.) im Bild eigentlich verhältnismäßig einfach als Fälschung zu erkennen. Dennoch werden sie geglaubt und zirkulieren weitläufig im Netz.

Und zukünftig sollen Menschen dann inhaltlich glaubwürdige, weil speziell für den gewünschten Zweck generierte KI-Medien als Fälschung enttarnen? Wegen verschwommener Zahnlücken oder einer leicht verwischten Iris? Weil ein paar Haare seltsam abstehen? Weil die Stimme an einer Stelle ungewohnt intoniert? Weil ein Video nur zu 95 Prozent lippensynchron ist?

Dass allein mehr (oder überhaupt) Medienkompetenz eine mögliche Deepfake-Gefahr aus der Welt schaffen kann, ist meines Erachtens illusorisch. Auch weil wir damit rechnen müssen, dass Deepfakes irgendwann selbst von Profis nicht mehr mit bloßem Auge erkannt werden können. Generative KI steht trotz der krassen Fortschritte der letzten Jahre am Anfang ihrer Entwicklung.

Entweder, wir finden eine technische Lösung, oder wir enden so, wie es "Deepfake-Erfinder" Ian Goodfellow schon 2017 prognostizierte: in einer Welt, in der wir Fotos und Videos nicht mehr trauen dürfen - und deshalb auch echten Aufnahmen nicht mehr ohne weiteres glauben.

>> Deepfake-Test: Erkennen Menschen synthetische Medien?

Zukunft der Computer jetzt!

🏠💡 Weshalb Matter ein Gamechanger fürs Smarthome ist

🥽🆕 Update macht Meta Quest 2 besser

👋🥽 OpenXR integriert Haptik-Standards

🤖💬 Deepmind- und Linkedin-Gründer gründen Sprach-KI-Unternehmen

🚗💰 Intel bringt Mobileye an die Börse

🐷🤖 Grunz-KI entdeckt glückliche Schweine

MIXED.de ohne Werbebanner

Zugriff auf mehr als 9.000 Artikel

Kündigung jederzeit online möglich

👓 der Woche: Magic Leap 2 kommt gut aus den Startlöchern

Bild: Magic Leap

Es gibt erste, unabhängige Berichte über Magic Leap 2. Und die fallen positiv aus. Speziell das weitere Sichtfeld und die Dimmtechnologie werden gelobt.

>> Magic Leap 2: Neue AR-Brille überrascht Tester

MIXEDCAST #289: Wie entsteht eigentlich ein VR-Spiel?

Wie entsteht ein VR-Spiel: von der Idee bis in den Store? Peter Bickhofe ist einer der Köpfe hinter dem Sci-Fi-Shooter DAVID für Meta Quest 2. Im Gespräch mit Christian erzählt er uns, wie der Entwickleralltag aussieht und welche Hürden es zu bewältigen gab und gibt.

Den MIXED.de-Podcast gibt es bei YouTube, Soundcloud, Spotify, iTunes, in der Google Podcast-App oder als RSS-Feed.

Etwas 😎😱 zum Abschluss

Bild: MyHeritage

Kennt ihr noch MyHeritage? Genau, die Webseite, die Porträtbilder verstorbener Personen mit einem KI-Tool zwinkern oder lächeln lässt. Die Porträts können jetzt auch lippensynchron sprechen.

>> MyHeritage: Neues KI-Tool lässt Verstorbene auf Fotos sprechen

Hinweis: Links auf Online-Shops in Artikeln können sogenannte Affiliate-Links sein. Wenn ihr über diesen Link einkauft, erhält MIXED.de vom Anbieter eine Provision. Für euch verändert sich der Preis nicht.