Motion Sense: Google zeigt Radar-Gestensteuerung für Pixel-4-Smartphones

Aus Project Soli wird Motion Sense: Google stellte heute die neue Gestensteuerung für Pixel-4-Smartphones offiziell vor. Sie soll der Anfang einer neuen Art von Interface werden.

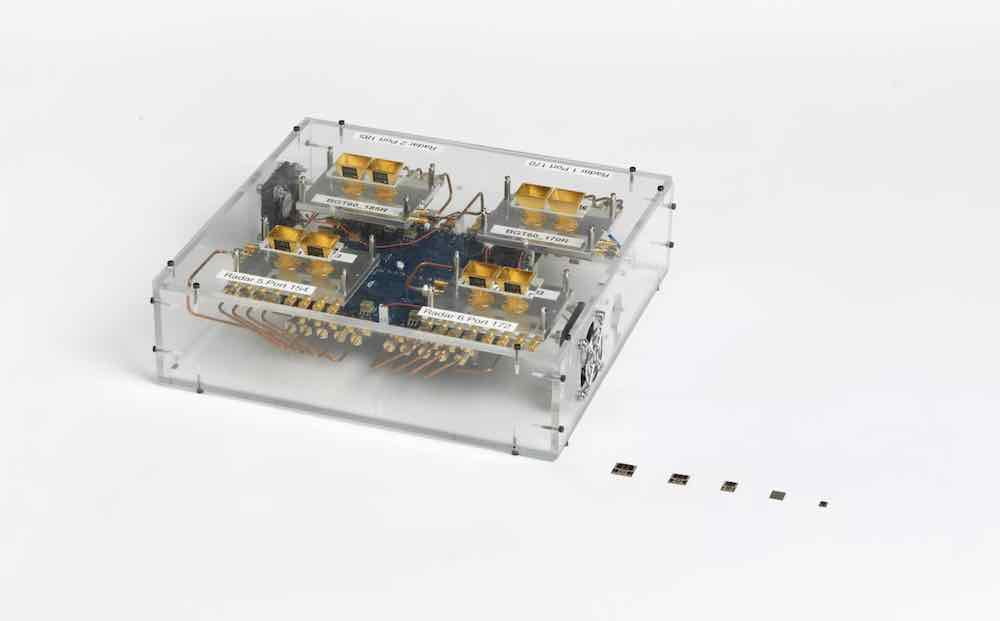

Fünf Jahre forschte Googles ATAP-Team, um die radarbasierte Technologie auf die Größe eines winzigen Chips zu miniaturisieren. Motion Sense erscheint nun als Erstes für Googles Pixel-4-Smartphones.

Zu Beginn bietet die Technologie drei neue Funktionen: Der Chip registriert den Nutzer dank Radarwellen innerhalb eines Abstands von circa einem halben Meter und kann so das Display abschalten, wenn man sich entfernt.

___STEADY_PAYWALL___Motion Sense kann zudem erfassen, wenn man nach dem Smartphone greift und aktiviert dabei das Display und die Gesichtserkennungssensoren.

Die prominenteste Funktion ist die Übersetzung einfacher Wischgesten in Befehle. So kann man Telefonanrufe ablehnen, den Alarm abschalten oder Tracks wechseln, ohne dass man das Smartphone berührt.

Motion Sense helps you get things done on your #pixel4 without touching it. Swipe to skip a song, silence a call with a flick of your hand, and unlock your phone super fast with face unlock. #madebygoogle pic.twitter.com/HAIBtBUsxE

— Google (@Google) October 15, 2019

MIXED.de ohne Werbebanner

Zugriff auf mehr als 9.000 Artikel

Kündigung jederzeit online möglich

Eine technische Meisterleistung

Ähnliche Funktionen gab es schon früher, aber sie waren kamerabasiert. Der Vorteil des Radarchips ist, dass er sehr wenig Energie verbraucht, allerfeinste Bewegungen erkennt und durch Materialien hindurch funktioniert, den Nutzer also nicht sehen muss.

Motion Sense kann jederzeit abgeschaltet werden und alle Gestenerkennung wird lokal auf dem Smartphone ausgeführt, ohne dass Google sie in der Cloud bearbeitet oder gar speichert.

Google gelang es, das Radar auf einen winzigen Chip zu reduzieren. BILD: Google

Motion Sense geht mit einem eingeschränkten Funktionsumfang an den Start. Der Grund: Google will die Nutzer mit dem neuen Interface nicht überfordern und stattdessen schrittweise an die Möglichkeiten der Technologie heranführen.

Für die Gestenerkennung hat Google künstliche neuronale Netze trainiert. Eines der größten Probleme neben der Minitiaturisierung war, dass Menschen unterschiedliche Wischgesten machen. Die KI muss zudem zwischen ähnlichen Gesten unterscheiden können, sodass Motion Sense nicht unabsichtlich aktiviert wird.

Titelbild: Google, Quelle: The Verge 1 & 2

Weiterlesen über Gestensteuerung:

- Apple arbeitet an einer 3D-Kamera für Gestensteuerung

- Apple ARKit: Software spendiert iPhone Gestensteuerung

- Hololens 2: Erste Eindrücke von Microsofts neuer AR-Brille

Hinweis: Links auf Online-Shops in Artikeln können sogenannte Affiliate-Links sein. Wenn ihr über diesen Link einkauft, erhält MIXED.de vom Anbieter eine Provision. Für euch verändert sich der Preis nicht.