Was ist ein NeRF und wie hilft diese Technologie VR, AR & dem Metaverse?

NeRF-Technologie hilft dabei, realistischere Objekte und Umgebungen für VR- und AR-Geräte bereitzustellen. Wie?

Millionen miteinander verbundener Polygone bilden 3D-Formen in Spielen und virtuellen Welten wie Horizon Call of the Mountain. Jedes Objekt wird gefärbt, schattiert und texturiert, um eine überzeugende Simulation zu schaffen. Obwohl dies zuverlässig funktioniert, bleibt Realismus eine Herausforderung. Einige Spiele, etwa Pistol Whip, verwenden stattdessen stilisierte Grafiken.

Die reale Welt besteht aus unvollkommenen, fließenden Formen. Selbst eine einfache Pappschachtel hat abgerundete Kanten, während das modellierte 3D-Pendant exakte 90-Grad-Winkel besitzt. Die Oberfläche kann winzige Fehler und Unebenheiten aufweisen, die Textur ist unregelmäßig und faserig und reflektiert das Licht in einem diffusen Braunton.

Natürliches Licht reflektiert in einem schwer zu simulierenden, hochkomplexen Strahlenspektrum. Raytracing löst dieses Problem, indem es Millionen von Lichtstrahlen simuliert, die von Objekten "abprallen" und gestreut werden, um detaillierte und realistische Bilder zu erzeugen. Die Ergebnisse sind beeindruckend. Allerdings erfordert die Verarbeitung eines komplexen Echtzeit-Raytracing-Renderings für ein Spiel oder eine VR-Welt enorme Grafikleistung.

Mit der NeRF-Technologie gibt es eine Lösung für das Problem der Nachbildung realer Objekte in einem virtuellen, digitalen Umgebung.

Inhalt

Was ist ein NeRF?

NeRF ist ein Akronym für Neural Radiance Fields (Neuronale Strahlungsfelder). "Radiance" ist ein anderes Wort für Licht, und so wie Raytracing das Spiel von Licht und Schatten überzeugend wiedergibt, erreichen Radiance-Felder denselben Realismus auf andere Weise: Ein Strahlungsfeld stellt Licht aus jedem Winkel und an jedem Punkt in einer Simulation dar.

Das bedeutet, dass ihr mit einer virtuellen Kamera durch ein NeRF fliegen könnt und realistische Darstellungen von Personen, Objekten und Umgebungen seht, als wären sie physisch anwesend. Wie bei Computerdarstellungen üblich, schwankt die Qualität: NeRFs, die schnell oder mit wenigen Quellbildern erzeugt wurden, erscheinen verrauscht oder mit Rissen. Der Gesamtrealismus des jeweils intakten Teils einer Szene ist jedoch ausgezeichnet.

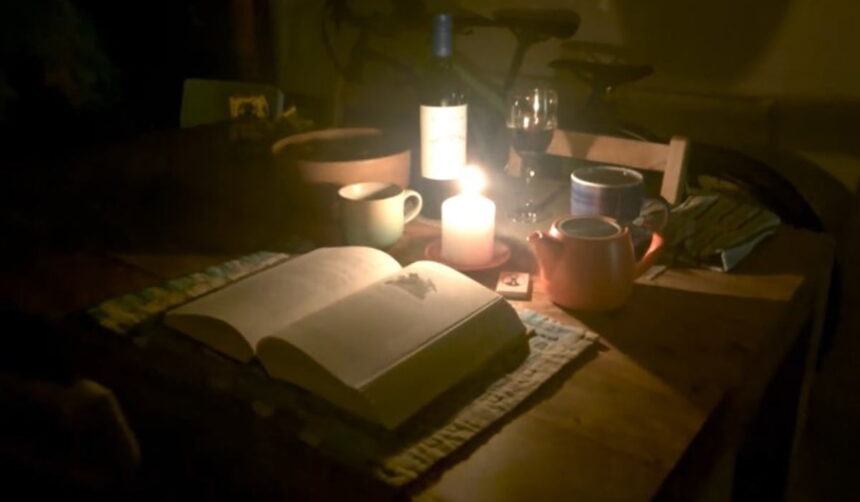

RawNeRF: Die neue Bild-KI von Google bringt Licht ins Dunkel | Bild: Ben Mildenhall / Google

Farbflecken und blockartige Artefakte minderten die Qualität früherer JPEG-Fotos. Die erste Welle von NeRF-Renderings weist ähnliche Mängel auf. Mit zunehmender Reife der Technologie werden diese Fehler seltener.

Ein weiteres wichtiges Detail im Namen "NeRF" ist das neuronale Rendering, das diese Technik auf Geräten mit niedrigem Stromverbrauch ermöglicht. Während für das Rendern einer hochauflösenden, fotorealistischen Szene mit hoher Bildwiederholrate und polygonalem Raytracing eine teure Grafikkarte erforderlich ist, kann qualitativ hochwertiges NeRF-Rendering auf Mobiltelefonen oder im Webbrowser durchgeführt werden.

Die Fähigkeit, mit kostengünstiger und effizienter Hardware schnell realistische 3D-Bilder zu erzeugen, macht NeRF-Technologie attraktiv.

Wie man reale Inhalte für ein NeRF erfasst

Um ein NeRF zu erstellen, nehmt ihr zunächst mehrere Fotos aus verschiedenen Winkeln in einer Umgebung oder um ein Objekt herum auf. In manchen Fällen ist es besser, ein Video aufzunehmen. So könnt ihr etwa NeRFs mit Videos erstellen, die von einer Drohne aufgenommen wurden. Die Technologie kann auch genutzt werden, um 3D-Spielinhalte als NeRFs zu erfassen.

Die besten Ergebnisse erzielt ihr, wenn ihr euch langsam um ein Objekt herum bewegt und es von allen Seiten aufnehmt. Eine App zur Erstellung von NeRFs verwendet dann die Fotos oder Videos, um ein Modell mit künstlicher Intelligenz zu trainieren, das virtuelle Objekte auf eurem PC, Smartphone oder VR-Brille nachbildet.

Wie NeRFs beim Aufbau eines Metaverse helfen können

Da sich diese Technologie noch in der Entwicklung befindet, steckt die Betrachtung von NeRFs in VR-Brillen ebenfalls in den Kinderschuhen. Trotzdem erscheint der Einsatz von NeRFs zum Aufbau virtueller Welten oder eines Metaverse fast unvermeidlich.

Während Skeptiker Schwierigkeiten haben, sich vernetzte virtuelle Welten vorzustellen, ist die futuristisch anmutende Vision von schlanken AR-Brillen nachvollziehbar, die virtuelle Objekte so detailliert und natürlich wie in der Realität erscheinen lassen.

Erinnert ihr euch an das obige Beispiel und die überraschend komplizierten Formen, Texturen und Lichteffekte eines einfachen Objekts wie dem Karton? Stellen euch nun eine Szene vor, die mit Schmuck, Kronleuchtern, Buntglas, mehreren Lichtern und Spiegeln gefüllt ist. Diese zusätzliche Komplexität kann einen leistungsstarken PC mit einem teuren Grafikprozessor leicht überfordern und die Bildrate beeinträchtigen.

MIXED.de ohne Werbebanner

Zugriff auf mehr als 9.000 Artikel

Kündigung jederzeit online möglich

Um virtuelle Welten mit realistischen Objekten und reichhaltigen Umgebungen zu erstellen, die Reflexionen, Schatten und andere Nuancen der natürlichen Welt enthalten, wird eine fortschrittlichere und weniger anspruchsvolle Lösung benötigt, als das Raytracing von Millionen von Lichtstrahlen.

Was ist mit Fotogrammetrie und LiDAR-Scans?

Fotogrammetrie- und LiDAR-Scans erfordern viele Fotos oder Videos, die mit der gleichen Methode aufgenommen werden wie NeRFs. LiDAR verwendet Laser, um Entfernungen für AR zu bestimmen. Einige fotogrammetrische Anwendungen verwenden das zur Beschleunigung der Verarbeitung.

Während die Aufnahmetechnik ähnlich der für NeRFs ist, werden die Bilder bei Fotogrammetrie mathematisch ausgerichtet, um eine 3D-Darstellung des Objekts als sogenannte Punktwolke zu erstellen.

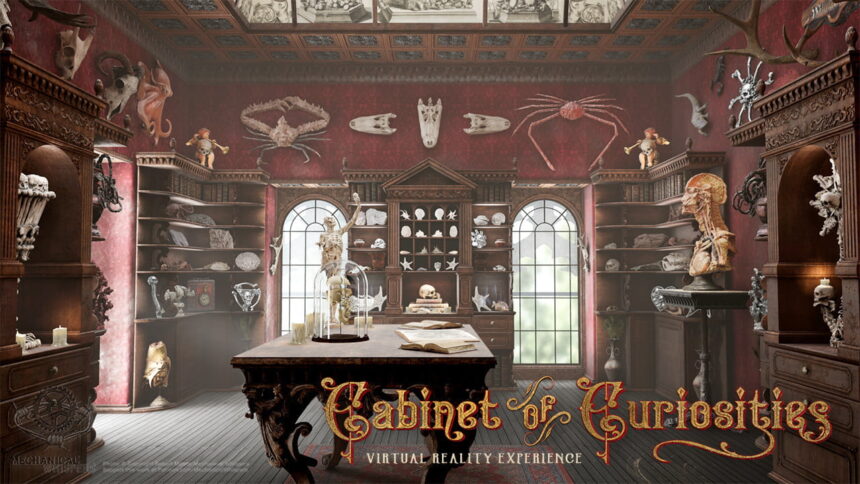

Das Cabinet of Curiosities von Robert Morris zeigt Hunderte von seltenen und wundersamen Objekten, die durch Fotogrammetrie digitalisiert wurden. | Bild: Mechanical Whispers

Punktwolken können Farbe und Textur genau wiedergeben, aber nicht die Strahlung oder Leuchtkraft. Wenn Licht auf einem Kristall glitzert, geschieht dies in einem bestimmten Winkel zum Licht.

Diese älteren Technologien eignen sich hervorragend für die erste Phase der Objekterfassung. Um ein fotorealistisches Modell zu erstellen, passen 3D-Künstler:innen die in ein polygonales Modell umgewandelte Punktwolke von Hand an und rendern es schließlich mit Raytracing.

Mit der NeRF-Technologie hingegen werden alle Nuancen des Lichts erfasst und der Realismus stellt sich automatisch ein.

KI-Fortschritte machen NeRFs schnell und einfach

Die NeRF-Technologie gibt es schon seit einigen Jahren. Das Konzept des Lichtfelds wurde erstmals 1936 von dem Physiker Andrey Gershun beschrieben. In den vergangenen Jahren haben sich neuronale Netze als Lösung für viele Herausforderungen im Bereich der Datenverarbeitung durchgesetzt.

Fortschritte in der künstlichen Intelligenz, etwa Bild- und Texterzeugung, Computer-Vision und Spracherkennung, beruhen auf künstlichen neuronalen Prozessen, um die komplexe und nahezu unvorhersehbare Funktionsweise der natürlichen Welt zu verarbeiten.

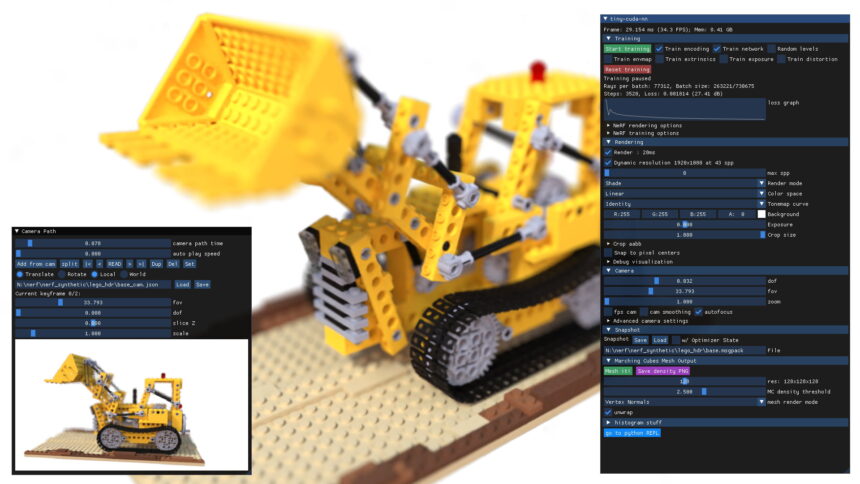

Nvidias Forscher demonstrieren eine neue KI-Methode, die den effizienten Einsatz von künstlicher Intelligenz in der Computergrafik ermöglichen soll. | Bild: Nvidia

Zu Beginn war neuronales Rendering zeitaufwendig. Jetzt, da Computer, Mobiltelefone und VR-Brillen spezielle Prozessoren und Grafikchips enthalten, ist die Darstellung von NeRFs schnell und einfach geworden. Instant-NGP von Nvidia liefert etwa sofort Ergebnisse, indem es Fotos kompiliert und den NeRF fast augenblicklich trainiert.

Selbst ein iPhone kann mit der Luma AI App NeRFs erstellen. Die jüngsten Fortschritte von Google machen die NeRF-Technologie schneller, und die NeRF-Forschung von Meta benötigt weniger Fotos, um eine überzeugende Darstellung zu schaffen.

Die NeRF-Technologie schreitet weiter voran und wird vielseitiger. Das neuronale Rendering dürfte dementsprechend eine wichtige Rolle bei der Erstellung virtueller Objekte und Umgebungen spielen, die virtuelle Welten und das Metaverse füllen sollen und die VR- und AR-Brillen in Zukunft zu einer Notwendigkeit machen könnten.

Wie kann ich selbst ein NeRF erstellen?

Lest unseren Guide zur Erstellung von NeRFs und wie ihr sie mit einer VR-Brille anschauen könnt.

Hinweis: Links auf Online-Shops in Artikeln können sogenannte Affiliate-Links sein. Wenn ihr über diesen Link einkauft, erhält MIXED.de vom Anbieter eine Provision. Für euch verändert sich der Preis nicht.