Meta Quest 3 kann Räume viel besser verstehen

Meta Quest 3 hebt das Raumverständnis von Quest-Headsets auf eine neue Stufe. Meta erklärt, was genau neu ist.

Die Informationen entstammen einer offiziellen Support-Seite, die Meta wahrscheinlich verfrüht online gestellt hat. Meta Quest 3 wird am 27. September auf der Meta Connect 2023 im Detail vorgestellt. Auf die Seite zuerst aufmerksam gemacht hat Twitter-Nutzerin Luna.

Meta Quest 3 ist für Mixed Reality optimiert und wird dank hochwertigem Farb-Passthrough und einer neuen Sensorarchitektur die physische Umgebung und digitale Elemente glaubhafter vermischen können als frühere Quest-Headsets.

Grundlage dieser Mixed Reality ist, dass das Gerät räumliche Daten über die Umgebung erheben, d.h. Anordnung und Beschaffenheit von Räumen erkennen, sowie die darin befindlichen Objekte einordnen und unterscheiden kann.

Was räumliche Daten sind und was sie bringen

Auf der Support-Seite geht Meta auf die räumlichen Daten ein, die Quest-Headsets und insbesondere Meta Quest 3 erheben. Um dieses Feature zu nutzen, müsst ihr jeder einzelnen App zuerst die Erlaubnis dafür geben. Erteilt ihr keine Erlaubnis, kann dies zu einer Verschlechterung der Mixed-Reality-Erfahrung führen oder dazu, dass die App gar nicht erst startet.

Der Tiefensensor (Mitte) der Meta Quest 3 ermöglicht bessere Mixed Reality und neue Anwendungsszenarien. | Bild: Meta

"Räumliche Daten beziehen sich auf die Informationen, die über die Größe, Form und Position von Wänden, Oberflächen und Objekten in einem physischen Raum gesammelt werden", schreibt Meta auf der Seite. "Apps, die virtuelle und reale Umgebungen miteinander vermischen, verwenden räumliche Daten, um den Raum um Sie herum zu verstehen und zu wissen, wo Sie sich in diesem Raum befinden."

Das Headset kreiert ein digitales Duplikat der Umgebung, indem es

MIXED.de ohne Werbebanner

Zugriff auf mehr als 9.000 Artikel

Kündigung jederzeit online möglich

- Objekte und Oberflächen erkennt,

- Objekte klassifiziert (Beispiel: Tisch, Couch, Fenster) und

- die Größe, Form und Entfernung dieser Objekte im Verhältnis zueinander und zum Headset schätzt.

Die Erhebung räumlicher Daten ermöglicht drei Anwendungen. Digitale Objekte können:

- an physische Objekte geheftet oder darauf platziert werden,

- an physischen Objekten abprallen oder auf andere Weise mit diesen interagieren und

- sich realistischer innerhalb eines Raums und an physischen Objekten vorbeibewegen.

Meta Quest 3 unterstützt neue Arten räumlicher Daten

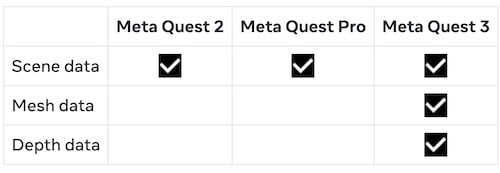

Räumliche Daten setzen sich Meta zufolge aus drei Datenquellen zusammen: Scene Data, Mesh Data und Depth Data.

Scene Data, so erklärt Meta, ist ein vereinfachtes Modell des umgebenden Raums. Mesh Data umfasst Informationen zur Form und Struktur von physischen Objekten und erlaubt realistische Interaktionen zwischen digitalen und physischen Objekten. Depth Data schließlich enthält Informationen zu Entfernungen zwischen Objekten und sorgt dafür, dass digitale Objekte realistisch im Raum gerendert und durch physische Objekte verdeckt werden. Nur Meta Quest 3 unterstützt alle drei Typen räumlicher Daten.

Diese Tabelle zeigt, welche Arten räumlicher Daten Meta-Quest-Headsets unterstützen. | Bild: Meta

Zurückzuführen ist dies auf den Tiefensensor der Meta Quest 3, der zum ersten Mal in einem Quest-Headset verbaut ist und eine genaue Kartografierung und Raumvermessung der Umgebung erlaubt. Ein Video veranschaulicht diesen Prozess und welche Arten von Interaktionen dadurch möglich werden.

- Luna @ Twitter

- Meta: Manage spatial data sharing on Meta Quest

Hinweis: Links auf Online-Shops in Artikeln können sogenannte Affiliate-Links sein. Wenn ihr über diesen Link einkauft, erhält MIXED.de vom Anbieter eine Provision. Für euch verändert sich der Preis nicht.