Reales Lächeln für virtuelle Avatare

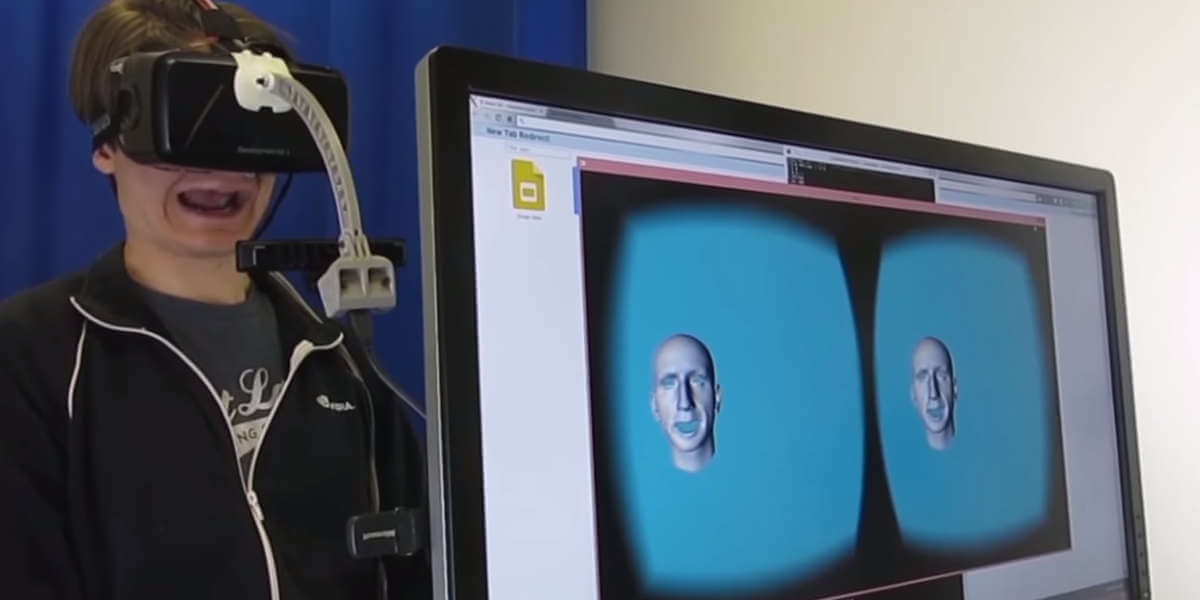

Hao Li ist Forscher an der Universität "Southern California". Gemeinsam mit Kollegen hat er einen Weg gefunden, Gesichtsausdrücke von Oculus-Rift-Nutzern zu erkennen und live auf einen virtuellen Avatar zu übertragen.

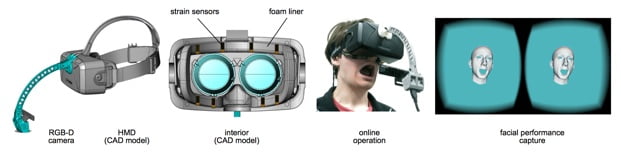

Dafür wurde die VR-Brille mit einer zusätzlichen Kamera modifiziert, die auf den Nutzer gerichtet ist. Diese spezielle Nahfeldkamera erkennt die Bewegungen der Mundpartie, während zusätzliche Sensoren im Kopfteil von Oculus Rift Muskelbewegungen messen. Diese speziellen Sensoren können den Kraftaufwand einer Bewegung erkennen. Notwendig werden sie, da durch die VR-Brille der obere Kopfteil des Nutzers komplett verdeckt ist. Eine rein optische Lösung, die die Gesichtszüge über die Bilder einer Kamera interpretieren kann, würde daher nicht zuverlässig funktionieren.

Ganz links sieht man die zusätzliche Kamera für die Mundpartie, im Bild daneben die Sensoren, die Muskelbewegungen erkennen.

Mit dieser Kombination aus optischen Daten und der Bewegungsmessung der Sensoren kann die Gesichtsmimik, schaut man sich die aktuellen Demos an, relativ exakt erkannt werden. Allerdings braucht die Software dafür vorab noch eine kurze Trainingsphase, in der das Gesicht des Probanden ausgemessen wird. Diese Kalibrierung könnte in Zukunft wegfallen, wenn der Software genug Daten von vielen unterschiedlichen Gesichtszügen und Mimiken zur Verfügung stehen.

Sponsored by Facebook

Die Anwendungsbereiche dieser Technologie sind vielfältig. Beispielsweise könnten in Spielen oder interaktiven Filmen virtuelle Charaktere darauf reagieren, ob der Nutzer lächelt oder traurig dreinschaut und den Handlungsverlauf entsprechend anpassen. Besonders Facebook darf sich über diese neue Technologie freuen, die von Facebooks-Tochter Oculus VR gefördert wurde.

Zuckerberg und Co. suchen nach Wegen, wie sie die virtuelle Realität zur sozialen Vernetzung einsetzen können, also eine Art Virtual-Reality-Version des Social Networks für jedermann. Avatare dürften dafür ein möglicher Lösungsansatz sein, sofern man es schafft, dass diese ihr reales Ebenbild ausreichend authentisch vertreten. Dass die Gesichtsmimik korrekt erkannt wird, ist ein erster Schritt in diese Richtung. In Kombination mit anderen Technologien, wie dem Augentracking der VR-Brille FOVE oder der Gestensteuerung von Leap Motion, scheint es tatsächlich möglich in naher Zukunft virtuelle Avatare zu erstellen, die auf natürliche, menschliche Art und Weise mit Blicken, Gesten und Mimik mit ihrer Umgebung interagieren können.

MIXED.de ohne Werbebanner

Zugriff auf mehr als 9.000 Artikel

Kündigung jederzeit online möglich

Hinweis: Links auf Online-Shops in Artikeln können sogenannte Affiliate-Links sein. Wenn ihr über diesen Link einkauft, erhält MIXED.de vom Anbieter eine Provision. Für euch verändert sich der Preis nicht.