Fake-Media im positiven Sinne: Eine neue Deepfake-GAN-Methode für medizinische Aufnahmen soll hochauflösende Trainingsdaten für Diagnose-KIs liefern.

Künstliche Intelligenz soll Ärzte zukünftig bei Diagnosen entlasten, gerade bei jenen, die visuell anspruchsvoll sind: zum Beispiel die frühe Krebserkennung auf einem CT-Scan. Die pixelgenaue Analyse der KI kann gefährliche Zellstrukturen im Optimalfall früher identifzieren als jede menschliche Expertin. Kürzlich zeigten Wissenschaftler eine KI-Software, die sich entwickelnden Brustkrebs bis zu fünf Jahre im Voraus finden können soll.

Nun wird es mittlerweile Allgemeinwissen sein, dass die Präzision von KI-Aktivitäten jedweder Art mit der Verfügbarkeit von Trainingsdaten zusammenhängt. Das gilt insbesondere im medizinischen Kontext. Gerade hier kann es allerdings sein, dass die notwendigen Daten zum Schutz der Privatsphäre unter Verschluss gehalten werden.

Deepfakes zum Wohle der Menschheit

Es existiert ein Ausweg aus diesem Dilemma: Die mächtige KI-Bildfälschungsmethode nach dem GAN-Prinzip, im Alleingang verantwortlich für die Deepfake-Debatte der letzten Monate mit teils grausligen Anwendungen, ist in der Lage, anhand echter medizinischer Bilder weitere künstliche zu erstellen und so die Menge an Trainingsdaten für die eigentliche Diagnose-KI zu steigern (siehe Titelbild).

So die Theorie. In der Praxis allerdings müssen die Trainingsdaten für die Diagnose-KI nicht nur irgendwie vorliegen, sondern hochauflösend. Hohe Auflösungen sind allerdings bislang keine Stärke des GAN-Verfahrens.

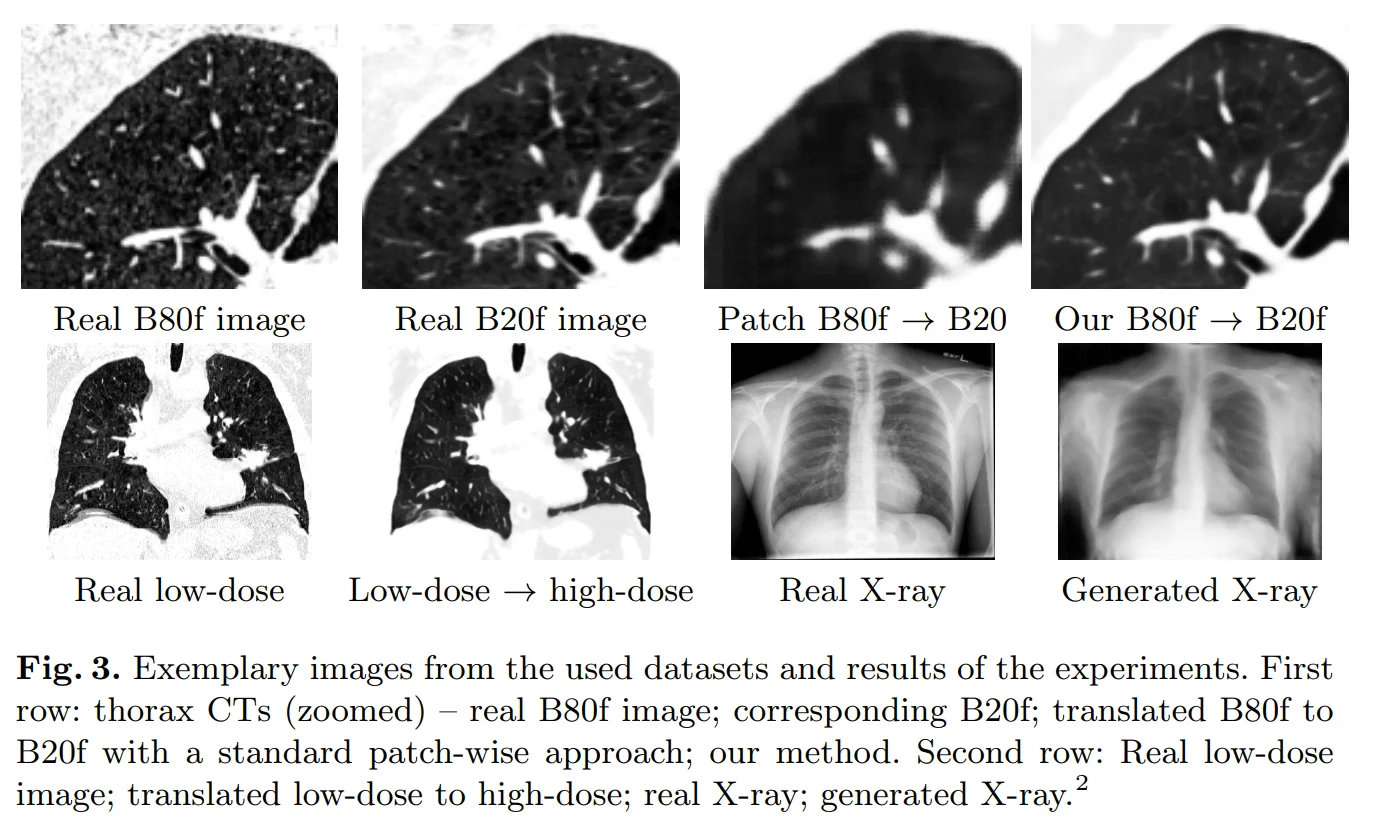

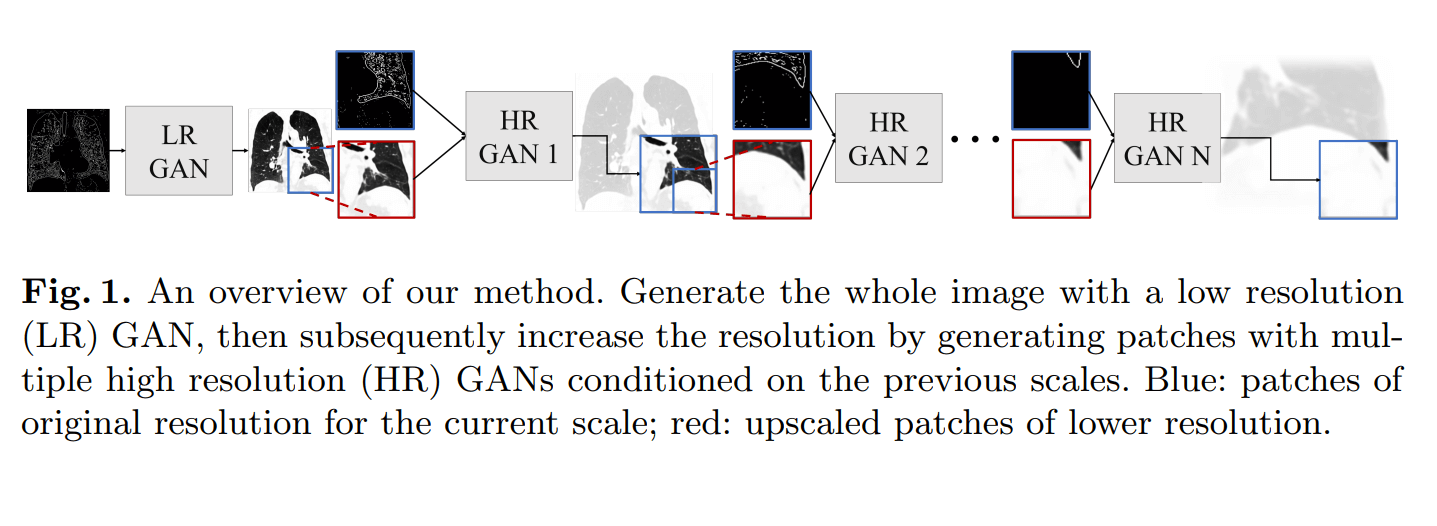

Forscher des Instituts für medizinische Informatik der Universität Lübeck schlagen jetzt eine neue "Multi-Scale-Gan"-Methode vor, die aus einer zunächst niedrig aufgelösten Komplettaufnahme einzelne Bereiche hochauflösend heraushalluzinieren kann - bei weniger Artefakten und insgesamt höherer Bildqualität als bisherige Methoden.

Bis zu 2.048 mal 2.048 Pixel sind bei Röntgenaufnahmen des Brustkorbs möglich, bei 3D-CT-Scans werden 512 mal 512 mal 512 Pixel erreicht. Das neue GAN-Verfahren läuft laut der Forscher bei einer Rechenlast, die auch ein schneller Krankenhaus-PC noch stemmen können soll und zwar sowohl für 2D- als auch 3D-Aufnahmen.

Titelbild & Quelle: Universität Lübeck