2017 wollte Standford-Forscher Michael Kosinski nachgewiesen haben, dass Künstliche Intelligenz Homosexualität am Gesicht erkennen kann. Jetzt ist der umstrittene Wissenschaftler mit einer ähnlichen Forschungsarbeit zurück: KI soll anhand von Gesichtsaufnahmen die politische Gesinnung ermitteln.

2017 veröffentlichte Kosinski eine Forschungsarbeit, die nachweisen sollte, dass auf Bildanalyse trainierte KI homosexuelle Menschen anhand ihrer Gesichtszüge erkennen kann. Bei Kosinskis Untersuchungen gelang das bei Fotos mit einer Genauigkeit von bis zu 81 Prozent.

Die Arbeit löste einen Proteststurm aus unter Wissenschaftlern und in den Medien. Die Kritik galt meist Kosinskis grundlegender Hypothese und weniger seinem wissenschaftlichen Vorgehen: Wie konnte Kosinski eine solche Studie überhaupt durchführen?

Der häufigste Vorwurf lautete, dass Kosinskis Studie Ansichten der Pseudowissenschaft Physiognomik teile, die auf Aberglauben, rassistischen Theorien und anekdotischen Beweisen basiert.

Der Forscher verteidigte sich: Auch Menschen könnten in ihren Urteilen basierend auf Äußerlichkeiten den Zufall schlagen. Es sei möglich, dass ein sensibler Algorithmus feiner differenzieren könne als Menschen.

Ebenso wie viele andere sei er verstört ob der Ergebnisse seiner Untersuchung. Er veröffentliche sie dennoch, da die Welt solche Analysemöglichkeiten, die auf einfacher KI-Technik beruhen, kennen müsse, so Kosinski damals.

Kosinskis neue Studie: Ist uns die politische Haltung ins Gesicht geschrieben?

Jetzt meldet sich Kosinski mit einer ähnlich gearteten Studie zurück: Er untersuchte, ob eine Bildanalyse-KI anhand von Internetfotos verlässlich Rückschlüsse ziehen kann auf die politische Gesinnung einer Person. Die Arbeit wurde in der wissenschaftlichen Fachzeitschrift Nature publiziert.

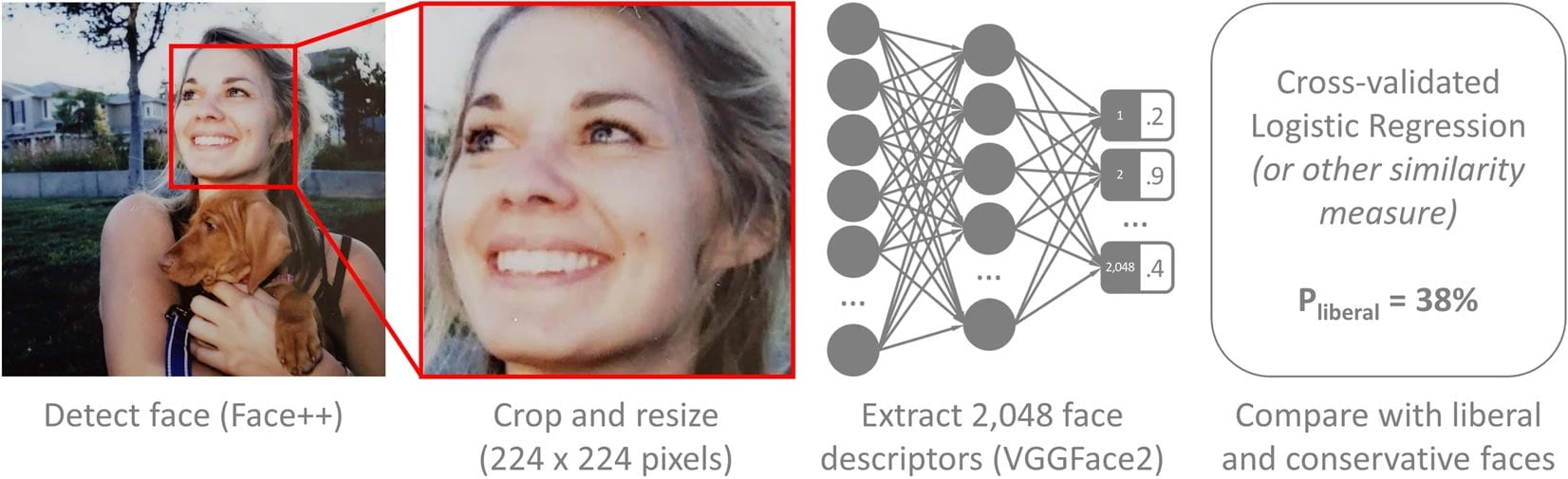

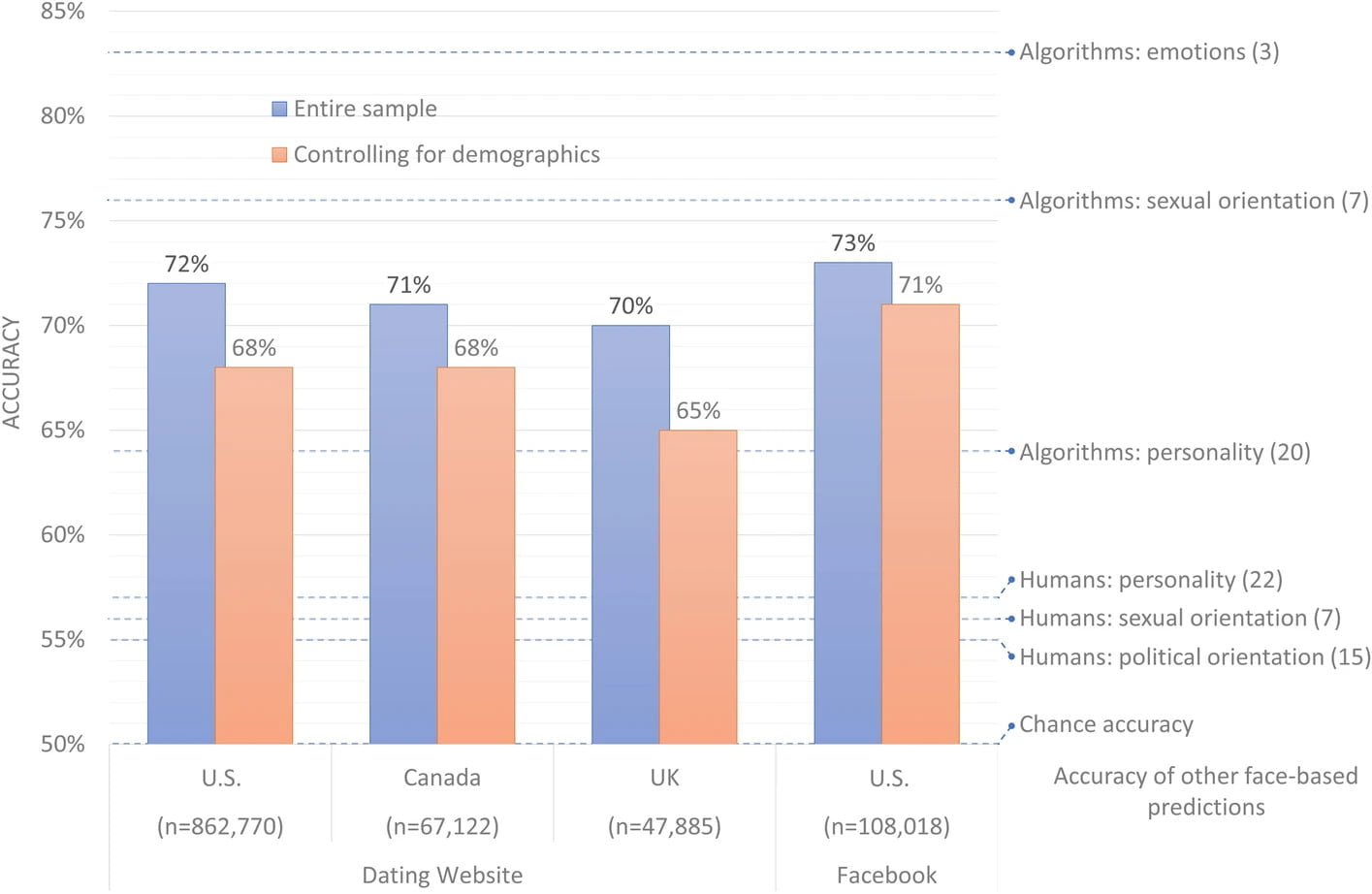

Die Stichprobe für Kosinskis Studie besteht aus Fotos von 1.085.795 Teilnehmern aus drei Ländern (USA, Großbritannien und Kanada), die aus Facebook und von Dating-Webseiten gezogen und mit Meta-Informationen zur selbst berichteten politischen Gesinnung, zum Alter und zum Geschlecht versehen wurden. Sie umfasst 347.000 nicht-weiße Teilnehmer. Mit einem Teil der Daten wurde die KI trainiert und gegen die verbliebenen Fotos getestet.

"Diese selbst ausgewählten, natürlichen Bilder vereinen viele potenzielle Hinweise auf die politische Orientierung, die von der Mimik und Selbstdarstellung bis zur Gesichtsmorphologie reichen", schreibt Kosinski in seiner Studie.

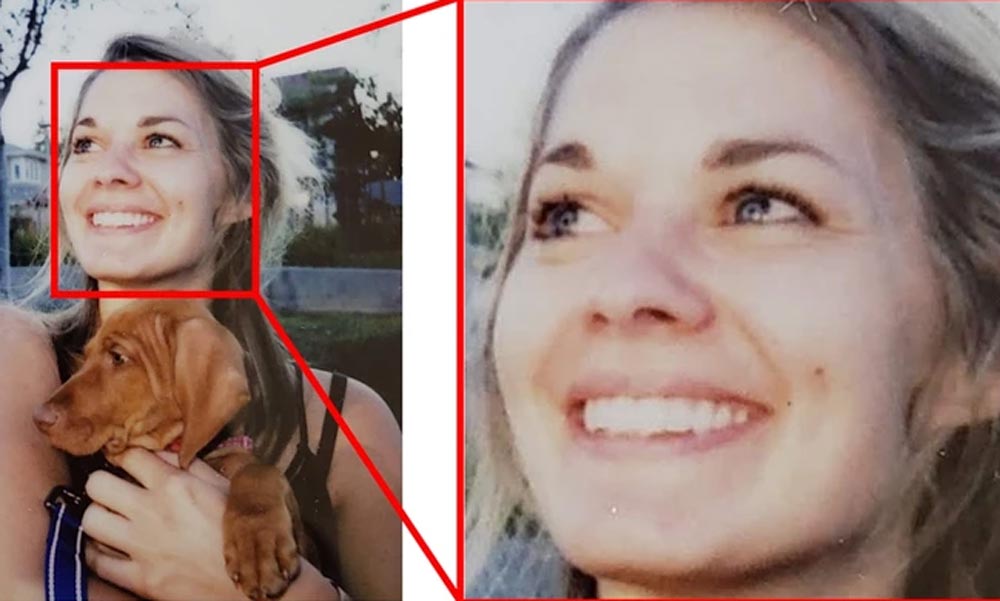

Um die Einflüsse von Umgebungselementen oder beispielsweise Kleidung auf die KI-Auswertung zu reduzieren, schnitt Kosinski die Fotos vor dem KI-Training möglichst eng auf das Gesicht zu.

Für die eigentliche Bildanalyse verwendete Kosinski einen frei verfügbaren Open-Source-Algorithmus statt eines selbstentwickelten Systems. Bewusst, wie er schreibt, da er kein System speziell für die Politikanalyse habe entwickeln wollen.

Liberale gucken häufiger überrascht

Legt man Kosinskis Bildanalyse-KI zwei Bilder von Personen vor, die jeweils liberal und konservativ sind, soll sie die politische Gesinnung mit einer Genauigkeit von bis zu 73 Prozent korrekt zuordnen können. Das liegt signifikant über Zufall (50 Prozent) und deutlich über der Genauigkeit von Menschen (bis zu 55 Prozent) bei ähnlichen Tests.

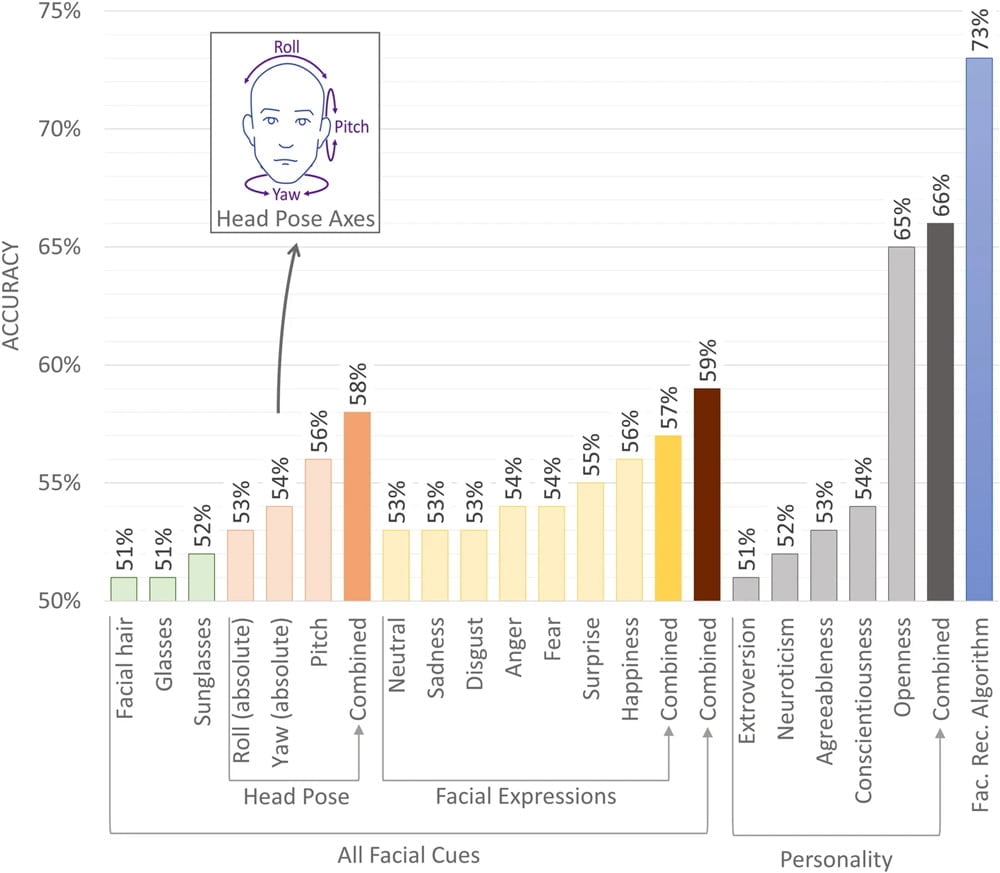

Wie genau die KI zu ihrer Schlussfolgerung kommt, kann Kosinski nicht sagen. Bei den zahlreichen Auswertungsfaktoren stachen die Kopfhaltung (58 %) sowie der Gesichtsausdruck (57 %) als Vorhersageparameter hervor.

"Liberale neigen dazu, direkter in die Kamera zu schauen, drücken eher Überraschung und seltener Abscheu aus", schreibt Kosinski. Die Gesichtsbehaarung und die Brillenwahl (beide 51 %) hingegen hatten laut Kosinski fast keinen Einfluss auf die politische KI-Kategorisierung.

Bei der Zuschreibung von Persönlichkeitsmerkmalen anhand der Fotos hatten die Kategorien "Offenheit für Erfahrungen" (65 %) und "Gewissenhaftigkeit" (54%) den größten Einfluss auf das algorithmische Urteil.

Allerdings existieren über diese Parameter hinaus zahlreiche weitere, die nicht vollständig erfasst sind, die aber bei der maschinellen Vorhersage eine starke Rolle gespielt haben müssen. Sonst hätte das System keine Genauigkeit von bis zu 73 Prozent erreichen können. Weitere Untersuchungen könnten diese Parameter aufdecken, so Kosinski.

Die Vorhersagbarkeit der politischen Orientierung anhand der Porträts impliziere nicht unbedingt, dass Liberale und Konservative von Natur aus unterschiedliche Gesichter hätten, schreibt Kosinski. Aus Sicht des Datenschutzes sei die Unterscheidung zwischen angeborenen und flüchtigen Gesichtsmerkmalen jedoch relativ unwichtig.

Über diese Arbeit wird gestritten werden – dafür wurde sie geschrieben

Wie schon bei Kosinskis Homosexualitäts-Detektor gibt es auch bei seiner neuen Studie viele Fragezeichen und mögliche Kritikpunkte. Zum Beispiel, dass eine politische Gesinnung veränderbar und relativ ist im Verhältnis zur Umwelt, oder dass Kosinski versucht, eine breite Skala in zwei einfache Kategorien zu pressen.

Ob die Genauigkeit des Systems repliziert oder sogar noch gesteigert werden kann, wie Kosinski annimmt, müssen weitere Forschungsarbeiten zeigen. Unabhängig davon ist der eigentliche Wert der Arbeit ein anderer: Sie zeigt, dass es Menschen gibt, die über solche Überwachungssysteme nachdenken und sie bis zu einem gewissen Grad umsetzen können.

Denn was Kosinski auf Open-Source-Basis entwickelt hat, können andere ebenso mit Leichtigkeit und noch besser herstellen und beispielsweise als einfache App an Privatpersonen oder Behörden verkaufen. Clearview lässt grüßen.

Spätestens dann könnte es egal sein, ob eine KI-Vorhersage für Homosexualität, Politik oder Falschparken tatsächlich funktioniert – oder ob wir nur daran glauben, dass sie funktioniert. Die mit Gesichtserkennung begründete und unrechtmäßige Inhaftierung von Njeer Parks ist dafür ein eindrucksvolles Beispiel.

Dass Kosinski seine Arbeit insbesondere als warnenden Hinweis versteht, wird in seinem Schlusswort deutlich: Selbst auf dem aktuellen Niveau könne die maschinelle Vorhersage politischer Gesinnung "enorme Auswirkungen haben, wenn sie auf große Bevölkerungsgruppen in Situationen angewendet werden, in denen viel auf dem Spiel steht, wie etwa bei Wahlen." Selbst eine grobe Einschätzung psychologischer Eigenschaften von Zielgruppen könne die Effizienz von Massenmanipulation "drastisch erhöhen".

"Wir hoffen, dass Wissenschaftler, politische Entscheidungsträger, Ingenieure und Bürger davon Notiz nehmen werden", schreibt Kosinski und fügt hinzu: "Erschießt nicht den Boten."