Für eine generelle Künstliche Intelligenz braucht es eine Rückbesinnung auf alte Stärken, sagt KI-Forscher Gary Marcus.

KI-Forscher Gary Marcus ist überzeugt: Mit Deep Learning allein ist eine generelle Künstliche Intelligenz, also eine KI, die viele Aufgaben beherrscht und perfektioniert, nicht zu erreichen.

Doch so eine Super-KI sei erstrebenswert, denn sie verspreche große Fortschritte für Wissenschaft und Technologie. Sie sei auch sicherer als aktuelle KI-Systeme, da sie weniger anfällig sei für Fehler und Vorurteile in Trainingsdaten. Aktueller KI fehle ein echtes Verständnis der Welt, kritisiert Marcus.

Der KI-Forschung empfiehlt Marcus daher einen Neustart mit einem Mix aus neuen und alten Methoden. Diese Botschaft vermittelt Marcus in seinem Buch "Rebooting AI", das er mit seinem Kollegen Ernest Davis geschrieben hat. In einem Interview mit Technology Review und einem Podcast mit Lex Fridman legt er seine Argumente dar.

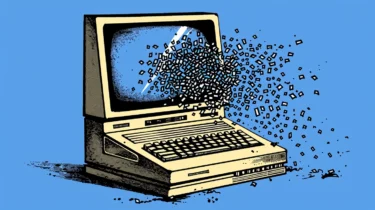

KI-Entwicklung: Marcus will Rückschritt für Fortschritt

Ein echtes Verständnis für die Welt sei nur mit einer Kombination aus maschinellem Lernen und regelbasierten KI-Systemen möglich, glaubt Marcus. Diese regelbasierten KIs waren jahrzehntelang die dominante KI-Form – bevor das maschinelle Lernen dank schnellerer und günstigerer Rechenleistung und Deep Learning abhob.

Regelbasierte KI-Systeme haben laut Marcus über Symbole, die umfassendes Wissen über die Welt speichern, sowie logische Schlussfolgerungen ein tieferes Verständnis der Welt. So könne eine KI etwa aus den Symbolen Autos und Fußgänger und mit kausalem Verständnis ableiten, dass eine Kollision der zwei Verkehrsteilnehmer fatal enden kann.

Dieser Ansatz wird auch "Good old fashioned AI" (GOFAI) genannt - und von vielen KI-Forschern für tot erklärt. Zu den Kritikern zählen etwa auch die Turing-Preisträger Yann LeCun und Geoffrey Hinton. Wenn es nach ihnen geht, hat Marcus zwar ein gutes Argument - bietet aber die falsche Lösung.

Künstliche Intelligenz versteht die Welt nicht

Marcus‘ Kritik an Deep-Learning-Systemen ist grundlegender Natur: Deep-Learning-KIs seien nur Statistik, verstünden keine Kausalität und aus ihnen sei noch nie ein abstraktes Symbol hervorgegangen.

Marcus nennt eine Flasche auf einem Tisch als Beispiel: Eine auf Bilderkennung trainierte Deep-Learnig-KI kann Flasche und Tisch zwar erkennen. Doch sie weiß nicht, was eine Flasche ist. Die KI versteht nicht, dass die Flasche ein Container ist, dass man sie mit einem Schraubverschluss abdichten kann und dass sie im Weltall nicht lange auf einem Tisch stehen bleiben würde.

Für Menschen seien solche kognitiven Modelle – Funktionsweisen – der Umwelt selbstverständlich. Marcus nennt das den "gesunden Menschenverstand", der Deep-Learning-Systemen abgeht. Regelbasierte Systeme könnten theoretisch dieses für uns selbstverständliche Wissen modellieren.

Theoretisch deshalb, da es im Grunde unmöglich ist, das ganze Weltwissen mit all den komplexen Zusammenhängen per Hand in ein Computersystem zu programmieren. Genau aus diesem Grund konnte die GOFAI ihr Versprechen nie erfüllen.

"Maschinelles Lernen ist ziemlich gut darin, aus Daten zu lernen, aber ziemlich schlecht darin, abstrakt zu repräsentieren. Regelbasierte KI ist ziemlich gut in Abstraktion, aber das muss per Hand programmiert werden", sagt Marcus im Interview.

Es sei daher nur logisch, eine Synthese beider Methoden zu versuchen.

Auf der Suche nach gesundem Maschinenverstand

Wie diese Synthese aussehen könnte? Marcus hat leider keine einfache Antwort parat. Es warte viel Forschungsarbeit, sagt er. Einige Ideen bietet er dennoch an.

Generelle künstliche Intelligenz benötige

- viele spezialisierte Subsysteme, das zeige die Hirnforschung,

- sie müsse kausale Relationen verstehen,

- und über integriertes Wissen verfügen, etwa durch Symbole oder direkte Regeln im Netzwerk. Auch das zeige die Hirnforschung.

Marcus räumt ein, dass seine Konzepte anspruchsvoll und derzeit kaum umsetzbar sind. Bis eine Maschine eine Form von "gesundem Maschinenverstand" besitze, könne es daher noch viele Jahrzehnte dauern – wenn es überhaupt jemals möglich sein wird.

Wer mehr über Marcus‘ Ansichten wissen will, kann sich hier einen Podcast mit ihm und dem KI-Forscher Lex Fridman anhören.

Titelbild: Gary Marcus, Quellen: Technology Review, Lex Fridman AI Podcast