Googles Pixel 4 könnte mit flotter KI-Assistenz und einer innovativen Radarsteuerung glänzen.

Ein geleaktes Werbevideo zeigt Googles kommendes Flaggschiff-Smartphone Pixel 4 im Einsatz. Unter anderem sieht man die Gestensteuerung mit Soli, Googles Radartechnologie, die seit Jahren in Entwicklung ist.

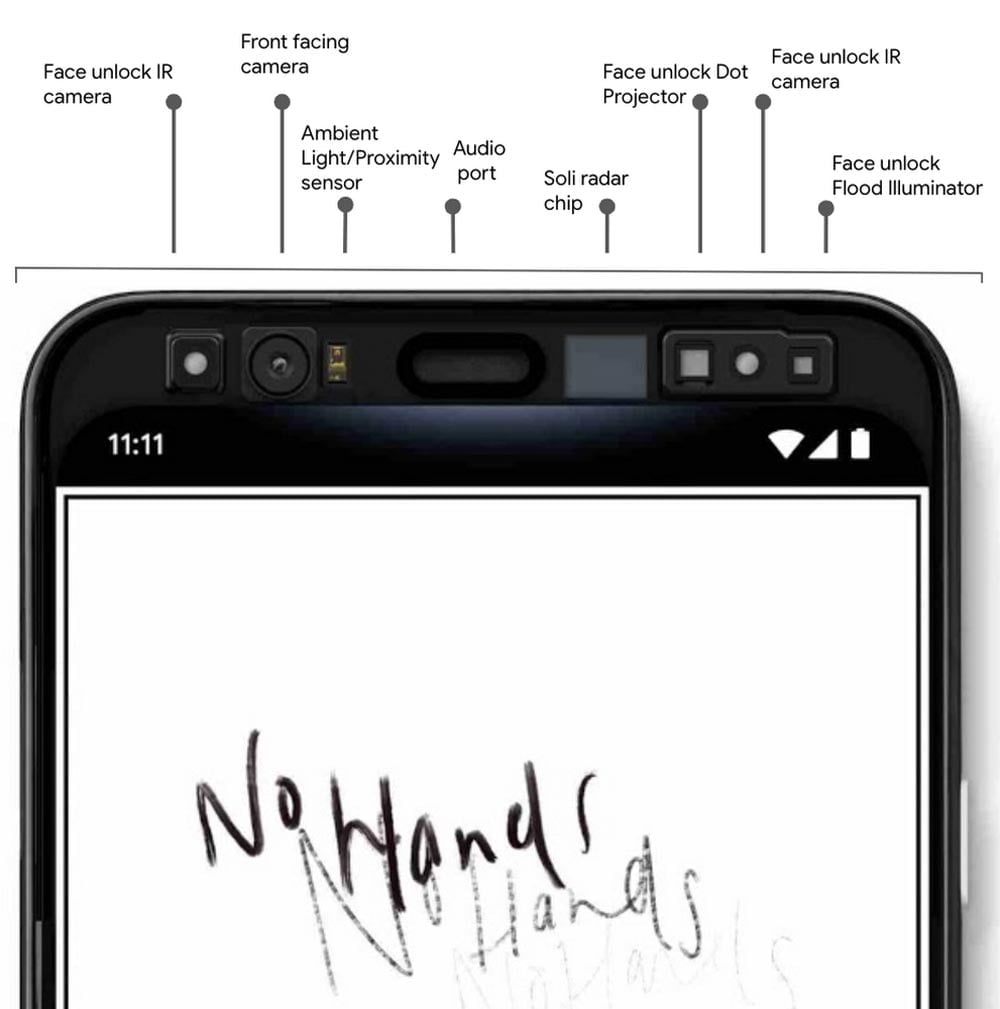

Das Radar erfasst Reflexionsmuster elektromagnetischer Wellen submillimetergenau, indem es eigene Wellen aussendet und dann misst, wie sie von einem Objekt zurückgeworfen werden. Das soll deutlich präziser funktionieren als zum Beispiel Gestensteuerung per Smartphone-Kamera.

Soli kann potenziell noch deutlich mehr: Die Mustererkennung in den Wellen ist so fein, dass sogar einzelne Objekte und deren Beschaffenheit wie Dichte, Form, Oberflächenstruktur und Gewicht identifziert werden können. Ob Soli beim Pixel 4 abseits der Gestensteuerung eine Rolle spielen könnte, ist noch nicht bekannt.

Der Google Assistant wird schneller

Das Video deutet außerdem eine bessere Sprach-KI für den Google Assistant an, die die Befehlseingabe über mehrere Sätze hinweg flüssig und schnell verarbeitet und dabei parallel auch anspruchsvolle Aufgaben meistern kann wie die Objekterkennung auf Bildern:

Im Beispiel sucht der Nutzer per Spracheingabe nach Aufnahmen aus Tokio, reduziert diese dann auf Bilder mit Essen darauf und versendet sie dann samt Kommentar in einem Messenger. Dass die Bildanalyse mittlerweile recht verlässlich funktioniert, beweist unter anderem Google Lens.

Dass Google im Trailer die Geschwindigkeit des Assistant betont, dürfte ein Hinweis auf den Start der Next-Gen-Version sein, die das Unternehmen erstmals im Mai auf der eigenen Entwicklerkonferenz vorstellte:

Der neue Assistant läuft lokal auf dem Smartphone und benötigt keine Internetverbindung mehr. Dadurch soll die Reaktionszeit der Sprachsteuerung deutlich schneller sein und laut Google-Chef Sundar Pichai sogar die Touch-Eingabe langsam erscheinen lassen.

Der neue Assistant dürfte über kurz oder lang auch für andere Android-Smartphones zur Verfügung stehen. Wann das Pixel 4 offiziell vorgestellt wird, ist noch nicht bekannt - wahrscheinlich ist es Anfang Oktober soweit.

Have a look on Google Pixel 4 Promo video ......which confirms gesture based navigation with soli sensor.

Don't forget to retweet ????#Google #Pixel4 #GooglePixel4 #Android10 #Pixel4XL #gesture #googlesoli #googlepixel4 GL pic.twitter.com/1P6OG2rUP5

— Techassist (@tcassist3) September 10, 2019

Quelle: Pro Android