Diktieren statt programmieren: Entwickler Sharif Shameem macht sich die schnelle Auffassungsgabe von OpenAIs Sprach-KI GPT-3 zunutze und bringt ihr mit zwei Beispielen rudimentäre Web-Entwicklung bei.

Anfang 2019 stellte OpenAI die Sprach-KI GPT-2 vor, auf deren Basis Entwickler Jacob Jackson den Code-Editor Deep TabNine entwickelte: Er bietet KI-basierte Autovervollständigung für Programmiercode.

Jackson musste GPT-2 lediglich mit Quellcodes der Datenbank GitHub trainieren und die KI konnte für 22 Programmiersprachen erkennen, welcher Befehl wahrscheinlich als nächster in einer Codezeile erscheinen müsste.

Deep TabNine zeigte, dass Sprach-KIs wie GPT-2 mehr sind als reine Text-Generatoren. Programmierer waren begeistert und beschrieben die KI-Ergänzung als "verblüffend", "verrückt" und "unglaublich".

Mit KI programmieren - Stufe zwei

Im Mai 2020 brachte OpenAI GPT-3 auf den Markt. Der Nachfolger von GPT-2 ist hundertmal größer, schreibt noch bessere Texte – und ist, besonders wichtig, für das sogenannte Few-Shot-Learning (Erklärung) geeignet: Neue Aufgaben meistert GPT-3 mit nur wenigen Trainingsbeispielen statt der etwa für Deep TabNine notwendigen zwei Millionen Code-Auszüge.

Diese Anpassungsfähigkeit kommt auch durch das umfassende Grundlagentraining zustande: Während für das Training von GPT-2 noch 40 Gigabyte Text der Online-Plattform Reddit genutzt wurden, ist GPT-3 mit ganzen 570 Gigabyte Text trainiert.

Ein Teil des riesigen Datensatzes kommt aus dem Textarchiv von Common Crawl. Die Non-Profit-Organisation sammelt seit 2011 systematisch Internettexte – egal ob Blog-Beitrag, Reddit-Kommentar oder eben Code-Beispiel.

Webseiten auf Zuruf: GPT-3 als Web-Entwickler

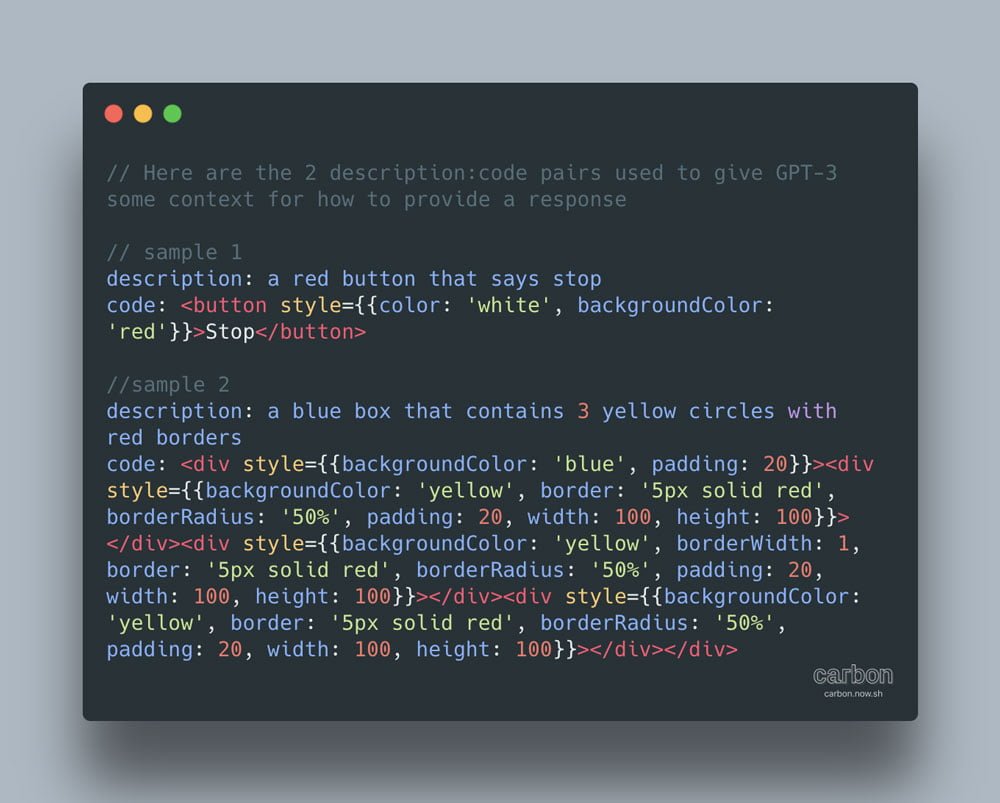

Computerspezialist Sharif Shameem hat über die neu verfügbare kommerzielle GPT3-Schnittstelle jetzt eine Art KI-Frontend-Entwickler trainiert. Frontend-Entwickler bauen hauptsächlich Nutzerinterfaces für eine App oder eine Webseite. Für das KI-Training benötigte Shameem lediglich zwei Code-Beispiele, die er GPT-3 fütterte.

Nach diesen zwei einfachen Beispielen kann GPT-3 anhand ausformulierter Beschreibungen JSX-Code generieren. So schreibt die KI etwa bei der Eingabe "Ein Button für jede Farbe des Regenbogens" passenden JSX Code für sieben verschiedenfarbige Buttons.

Der Sprachbefehl "Eine Tabelle der reichsten Länder der Welt mit den Spalten Name und BiP" erzeugt eine entsprechende Tabelle. Der Satz "Ein Button in der Farbe von Donald Trumps Haar" bringt einen gelben Button hervor. Das folgende Video zeigt eine Reihe an Beispielen der Sprache-zu-Code-Methode.

Die gleichen Ergebnisse seien auch für reinen HTML und CSS-Code möglich, schreibt Shameem. Für das Training der KI bräuchte es lediglich zwei weitere entsprechende Code-Beispiele.

Schnelllerner-KI: Der Trick ist vielfältiges Vorabtraining

Das umfassende Vorabtraining von GPT-3 macht Shameems programmierende KI überhaupt erst möglich. Während Deep TabNine mit sehr vielen Code-Beispielen trainiert werden musste, bringt GPT-3 das grundlegende Code- und Sprachverständnis bereits mit.

Die KI braucht anhand von wenigen Beispielen nur einen Fingerzeig in die richige Richtung, um Sprachbefehle in passenden Code zu verwandeln. Außerdem hat sie durch das ausführliche Vorabtraining mehr Kontextwissen im neuronalen Netz - wie Trumps Haarfarbe.

Noch muss kein Entwickler um seinen Job fürchten

Shameems Beispiel zeigt, dass uns OpenAIs GPT-3 näher an eine Zukunft bringt, in der Entwickler dem Computer - sogar im Wortsinn - sagen können, welchen Code er schreiben soll, anstatt Zeile für Zeile zu tippen. Deep TabNine-Erfinder Jackson jedenfalls bezeichnet KI-gestützte Programmierung als seine Zukunftsvision.

Jobs wird ein KI-Werkzeug wie das von Shameem vorerst nicht ersetzen, sondern die Arbeit von Entwicklern erleichtern und beschleunigen, indem es schnell rudimentären Code auswirft.

Langfristig könnten KI-Werkzeuge Arbeit von Entwicklern überall dort revolutionieren, wo repetitive Programmieraufgaben Alltag sind. Das gilt neben Web-Frontend-Profis laut Shameem auch für Backend-Entwickler. Sie müssten sich "auf einen wilden Ritt gefasst machen".

Der Entwickler geht auf Basis seiner GPT-3-Erfahrung sogar davon aus, dass eine generelle, vielseitige KI in weniger als zehn Jahren erreichbar ist - zuvor habe er auf mehr als 50 Jahre getippt.

Der Sprache-zu-Code-Generator ist nach Anmeldung hier verfügbar.

Titelbild: Twitter / @sharifshameem