Mit OpenAIs CLIP und Nvidias BigGAN könnt ihr Künstliche Intelligenz Bilder nach euren Beschreibungen generieren lassen. So geht’s.

Anfang 2021 stellte OpenAI CLIP vor, eine Bildanalyse-KI, die mit Bild- und Textdaten darauf trainiert wurde, zu erkennen, ob ein Bild zu einer Bildbeschreibung passt. In Kombination mit Bilder generierenden KIs wie DALL-E oder GANs (Erklärung) lassen sich so Systeme einrichten, die (mehr oder weniger) passend zu einer Beschreibung ein Bild generieren.

Mit Googles Colab und Open-Source-Implementationen solcher Bild-Systeme kann heute jeder ganz einfach KI-Bilder nach eigenen Beschreibungen generieren lassen. Ich habe eines dieser Systeme ausprobiert und zeige euch, wie ihr es nutzt.

KI-generiertes Bild in fünf Minuten

Ich nutze für meinen Versuch eine Variante von BigSleep des Twitter-Nutzers Advadnoun. BigSleep setzt auf CLIP und Nvidias BigGAN. Auf Github hat Nutzer alpha2phi dafür den Code einer Variante zusammengeführt, der über Googles Colab geöffnet werden muss.

Das geht etwa über diesen direkten Colab-Link. Um Colab nutzen zu können, benötige ich einen Google-Account.

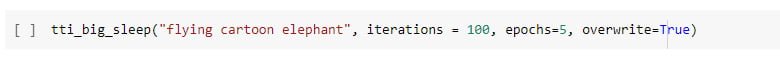

Ungefähr in der Mitte des Codes steht folgende Zeile:

“flying cartoon elephant” tausche ich durch meine Beschreibung aus, die Iteration- und Epoch-Werte lasse ich unverändert. Höhere Werte können bessere Ergebnisse erzielen, allerdings dauert die Bildberechnung dann länger. Mit den vorgegebenen Werten rechnet Colab etwa fünf Minuten pro Bild.

Zum Ausführen klicke ich in der Menüleiste oben auf "Laufzeit" und dort auf "Alle ausführen". Nun wird der Code ausgeführt und ich kann den Prozess in Colab nachverfolgen. Das fertige Bild wird am Code-Ende ausgegeben. Für einen weiteren Versuch tausche ich einfach die Beschreibung aus und starte den Code erneut.

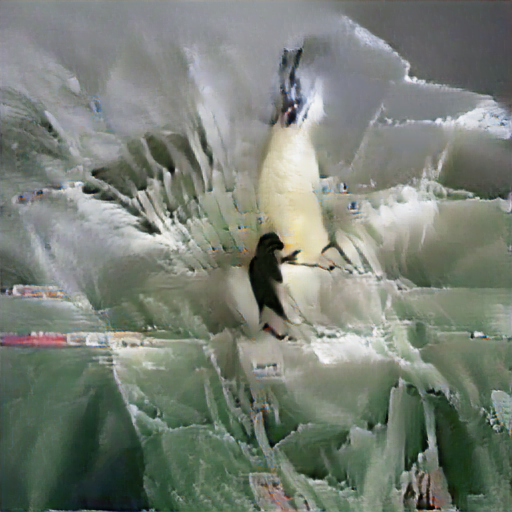

Pinguin-Kunst per BigGAN

Mit der von mir genutzten BigSleep-Variante generiere ich eine Reihe von Pinguinbildern nach verschiedenen Beschreibungen.

Weitere KI-Tools sind in der Entwicklung

Eine leistungsstärkere Variante von BigSleep sowie eine Variante, die auf einen weniger leistungsfähigen Open-Source-Nachbau von DALL-E setzt, lassen sich ebenfalls über Colab ausführen.

Twitter-Nutzer Advadnoun stellt direkte Links für BigSleep (CLIP plus BigGAN) und ein inoffizielles CLIP plus DALL-E zur Verfügung. Auch hier heißt es: Bildbeschreibung austauschen und den gesamten Code ausführen.

Advadnoun experimentiert aktuell außerdem mit der Möglichkeit, bestimmte Bildabschnitte nach der Generierung gezielt zu bearbeiten. Sein neuestes KI-Werkzeug LatentReVisions ist vorerst Unterstützern auf Patreon vorbehalten.

Couldn't wait to see what people will make, so it's out! I'll be adding features and making things easier to use in the future, but the experimental version is there. https://t.co/P5Vfp6CCn0

— Adverb (@advadnoun) May 3, 2021