Selbst die smarteste Künstliche Intelligenz nervt, wenn sie uns rauh ins Ohr knarzt. Mit einer neuen Sprachsynthese-Technologie will Nvidia künstliche Stimmen natürlich klingen lassen. Die Vorlage liefert, wie so häufig, der Mensch.

KI-Sprachsynthese hat in den letzten Jahren enorme Fortschritte gemacht. Längst können sich Alexa und Co. (Tipps) mit einer künstlichen Stimme ausdrücken, bei denen sich uns nicht mehr die Nackenhaare aufstellen. Vergessen sind die holprigen Stimmgeneratoren etwa alter Navigationssysteme, die abgehakt und statisch Wegrichtungen befehlen. Die Grenze zwischen synthetischer und natürlicher Stimme ist bei einfachen Anwendungen fast verwischt.

"Fast" und "einfach" sind bewusst hervorgehoben: Denn noch fehlt es künstlich generierten Stimmen an Dynamik und Gefühl bei der Intonierung. Das fällt bei langweiligen Alltagsansagen wie dem Wetterbericht nicht groß ins Gewicht.

Aber gerade dann, wenn der Inhalt eine besondere Emotionalität erfordert - etwa beim Vorlesen eines Buches oder gar bei Gesang - kann die Maschinenstimme in vielen Fällen lange nicht mit dem menschlichen Original mithalten. Wer regelmäßig unseren Podcast hört, weiß, weshalb ich von "vielen" und nicht von "allen" Fällen schreibe.

RAD-TTS: Menschen trainieren Nvidias neue Sprachsynthese

Mit RAD-TTS stellt Nvidia nun auf der Fachkonferenz Interspeech 2021 ein neues KI-Modell vor, das die emotionalen Eigenheiten einer menschlichen Stimme besonders effizient übernehmen und wiedergeben können soll. Eine einzelne Person soll das Modell mit der eigenen Stimme hinsichtlich des Tempos, der Tonalität, der Klangfarbe und weiterer Stimmcharakteristiken trainieren können.

Die einmal trainierte synthetische Stimme generiert dann mit diesen Charakteristiken aus geschriebenem Text neue Wörter und Sätze. Die künstliche Stimme kann dennoch grundlegend anders klingen als die Originalstimme: Ein älterer männlicher Sprecher etwa kann mittels Stimmkonversion seine Stimmeigenschaften auf die einer natürlich klingenden jungen weiblichen synthetischen Stimme übertragen.

Nvidia nutzte die RAD-TTS Sprachsynthese in der eigenen Videoreihe "I am AI" als Moderatorinnenstimme, die durch die Videos führt. Für den unmittelbaren Mensch-Maschine-Vergleich: Das ursprüngliche "I am AI"-Intro von der GTC 2017 wurde noch von einer menschlichen Sprecherin vertont, da laut Nvidias Verantwortlichen Tests mit synthetischen Stimmen damals nicht das gewünschte Ergebnis lieferten.

Nvidia investiert in KI-Sprachtechnologie

Nvidia sieht den Nutzen von RAD-TTS etwa im Gaming, um Menschen mit Stimmproblemen zu unterstützen oder um die eigene Stimme zwischen unterschiedlichen Sprachen zu übersetzen. Laut Nvidia kann RAD-TTS sogar die Auftritte berühmter Sänger und Sängerinnen nachahmen und dabei neben der Melodie auch den emotionalen Ausdruck im Song wiedergeben.

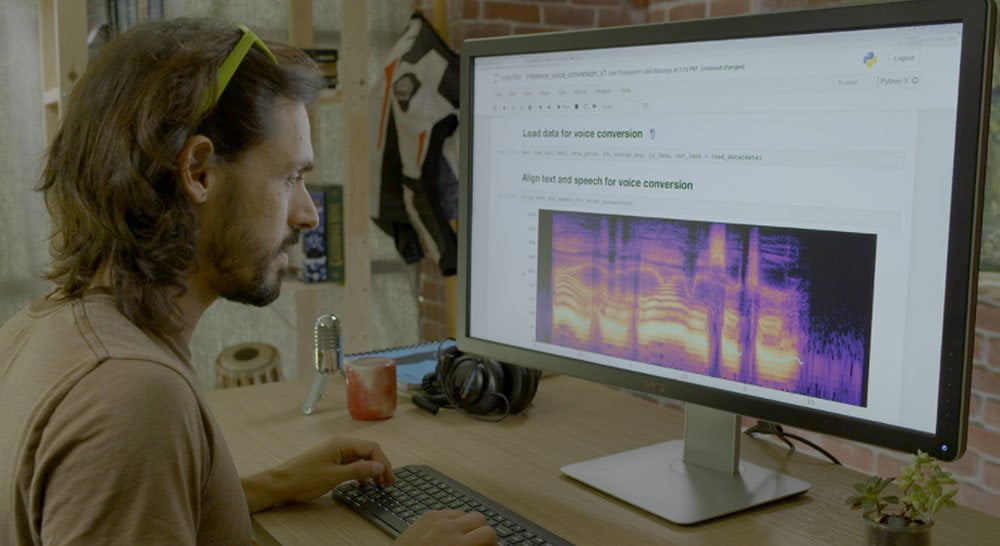

Neben RAD-TTS stellt Nvidia eine weitere KI-Audiotechnologie vor: NeMo ist ein Open Source Python-Toolkit, das die KI-Spachgenerierung und -erkennung mit Nvidia Grafikkarten beschleunigen soll. Über NeMo bietet Nvidia vortrainierte KI-Modelle wie RAD-TTS an, die Entwickler:innen nach ihren Wünschen feintunen können. Die Modelle wurden mit Mozillas Open Source Datensatz Common Voice vortrainiert, der mehr als 14.000 Stunden Stimmmaterial aus 76 Sprachen enthält.

Mit SPGI-Speech stellt Nvidia noch ein sehr spezifisches KI-Modell für Sprache vor: Es wurde mit 5.000 Stunden Audioaufnahmen aus Telefonkonferenzen von Unternehmen mit Investoren trainiert für eine "vollständig formatierte Ende-zu-Ende-Spracherkennung".

"Diese Modelle können automatisierte Kundenservice-Leitungen für Banken und Einzelhändler sprachlich unterstützen, Videospiel- oder Buchfiguren zum Leben erwecken und Echtzeit-Sprachsynthese für digitale Avatare leisten", schreibt Nvidia.