Kann ein Roboter in wenigen Minuten das Laufen lernen? Forscher von Nvidia und der ETH Zürich zeigen, dass es möglich ist.

Boston Dynamics tanzende und Parkour laufende Roboter sind bekannt, beeindruckend und gutes Marketing für das Unternehmen, das seit knapp 30 Jahren an der Zukunft der Robotik forscht. Der Hunderoboter Spot Mini ist für ausgesuchte Kunden erhältlich und macht sich durch seine Sensorik und robuste Bewegungssteuerung nützlich. Letztere ist allerdings vor allem ein Produkt menschlicher Arbeit – bisher setzt das traditionsreiche Robotikunternehmen wenig auf KI-Steuerung.

Der Grund: Das KI-Training von Robotern ist schwierig. Zwar ist es möglich, Roboter in einer Simulation mit dem bestärkenden Lernen zu trainieren und anschließend das Gelernte in der echten Welt einzusetzen, doch es gibt einige Hindernisse. Die zwei größten sind die Überwindung der Realitätslücke und der häufig große Trainingsaufwand in der Simulation bei fragwürdigem Ergebnis.

Paralleles KI-Training für schnelles Roboterlernen

Doch es gibt Fortschritte: Kürzlich zeigte Facebook, dass sich KI-Training in der Simulation auf die Realität übertragen lässt. Das Unternehmen stellte das KI-System Rapid Motor Adaption vor, das die Realitätslücke zumindest im Ansatz überwindet.

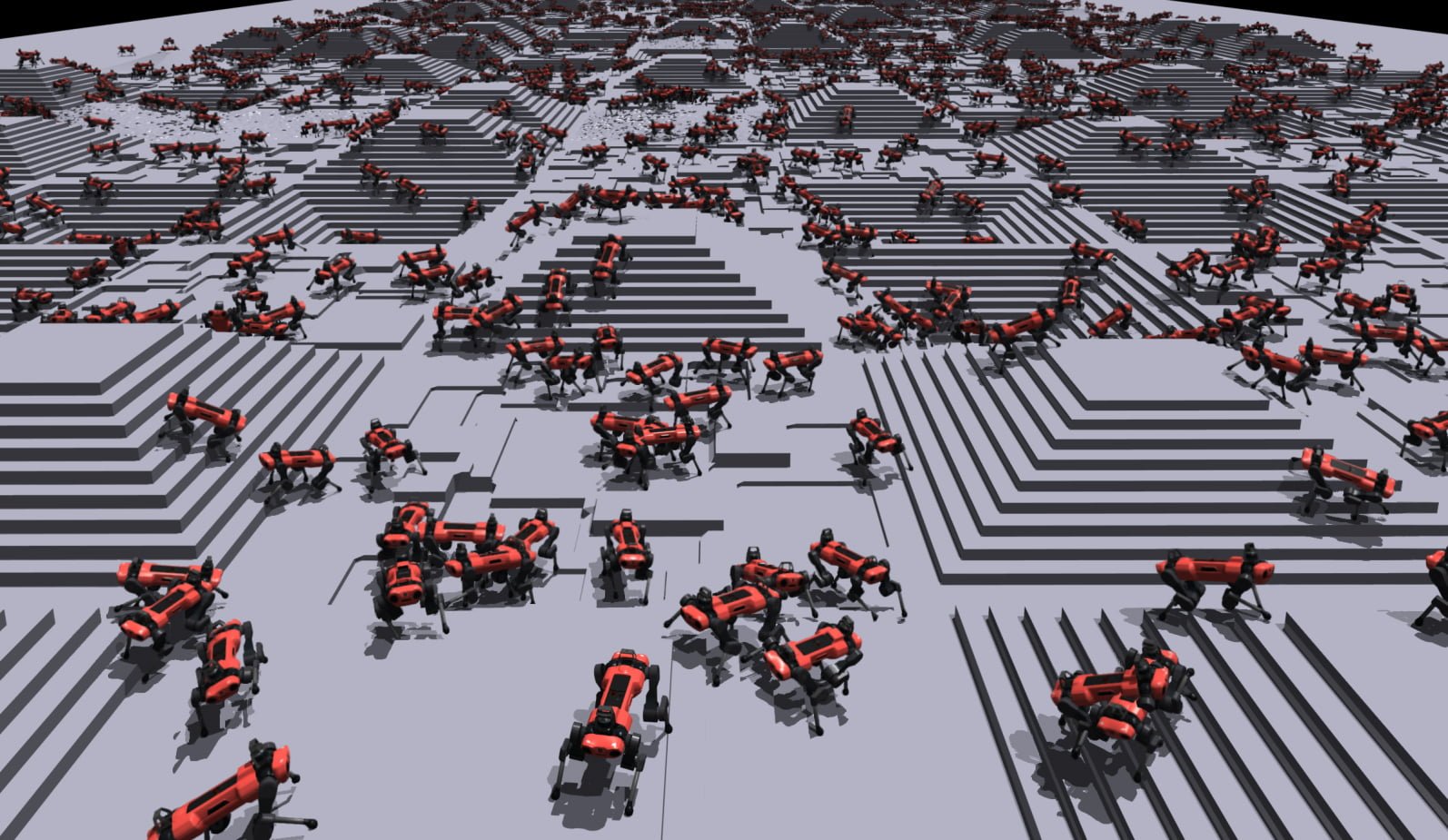

Jetzt zeigen Forscher von Nvidia und der ETH Zürich, dass sich tausende Roboter gleichzeitig auf einer Grafikkarte trainieren lassen und die Trainingszeit so von mehreren Tagen auf wenige Minuten reduziert werden kann.

Das Training tausender Roboter in einer Simulation erhöht die Menge verfügbarer Daten für das Training des Algorithmus massiv und beschleunigt so den Lernprozess. Bisherige Ansätze nutzten jedoch GPU-Cluster, die aufgrund notwendiger Kommunikation zwischen den GPUs und Einschränkungen in der Übertragungsgeschwindigkeit zu einem verhältnismäßig langsamen Trainingsprozess führen.

Die Forscher von Nvidia und der ETH Zürich entwarfen daher einen Algorithmus, der auf einer einzigen Nvidia RTX A6000 GPU mit 48 Gigabyte Speicher läuft und alle Daten auf dieser speichert. Das ermöglicht ein effizientes Training mit tausenden Robotern parallel.

Roboter lernen in weniger als vier Minuten laufen

Für das KI-Training der Roboter setzen die Forscher auf ein Curriculum, in dem die Roboter sich auf immer anspruchsvollerem Gelände bewegen müssen. Bei Tests sah das Forschungsteam stetige Fortschritte bei bis zu 20.000 gleichzeitig aktiven Robotern. Auf flachem Terrain konnten sich die Roboter bereits nach unter vier Minuten fortbewegen, auf unebenem Terrain inklusive Treppen in knapp 20 Minuten.

Die Forscher testeten außerdem den Sim2Real-Transfer und statteten einen ANYmal-Roboter mit einer in der Simulation gelernten Steuerungsrichtlinie aus. Der konnte sich fortbewegen und Treppen steigen, versagte jedoch häufiger bei Geschwindigkeiten über 0,6 m/s. Die Ursache liegt laut der Forscher in Ungenauigkeiten in der Höhenkarte, die der Roboter per Lidar-Scans erstellt.

Ein stabilerer Roboter ließe sich mit weiteren Techniken leicht erreichen, so die Forscher. Ziel der Arbeit sei es jedoch, zu zeigen, dass mit massiver Parallelität im bestärkenden Lernen eine robuste Steuerungsrichtlinie erlernt wird, die direkt auf realer Hardware verwendbar ist. Diese Methode sei auch für andere Aufgaben in der Robotik möglich und könne deren Entwicklung erheblich beschleunigen.