Forscher untersuchen, wie neuronale Netzwerke "denken". Die Ergebnisse zeigen, dass ein Netzwerk ähnlich dem menschlichen Gehirn Konzepte bilden kann: Ein Baum ist ein Baum ist ein Baum - und der wächst vielleicht in den Himmel, aber nicht im Himmel.

Neuronale GA-Netzwerke (Generative Adversarial) waren für einige der eindrücklichsten KI-Entwicklungen der letzten Jahre verantwortlich: Videofälschungen mit Deepfakes, das erste jemals versteigerte KI-Bild, künstliche Menschen und virtuelle Straßenzüge.

Die grundlegende Funktionsweise ist immer gleich: In einem GAN kooperieren zwei KI-Agenten. Einer erstellt ein Bild, der andere prüft es auf Glaubwürdigkeit. Die beiden Agenten spielen ein Bild hin und her, bis es passend zu den Anforderungen überzeugend aussieht. Diese Selbstkontrolle macht GANs so mächtig.

Forscher des MIT-IBM Watson Labs untersuchten die Netze nun auf ihre genaue Funktion: Wie „denken“ neuronale Netzwerke?

Bäume sind Bäume

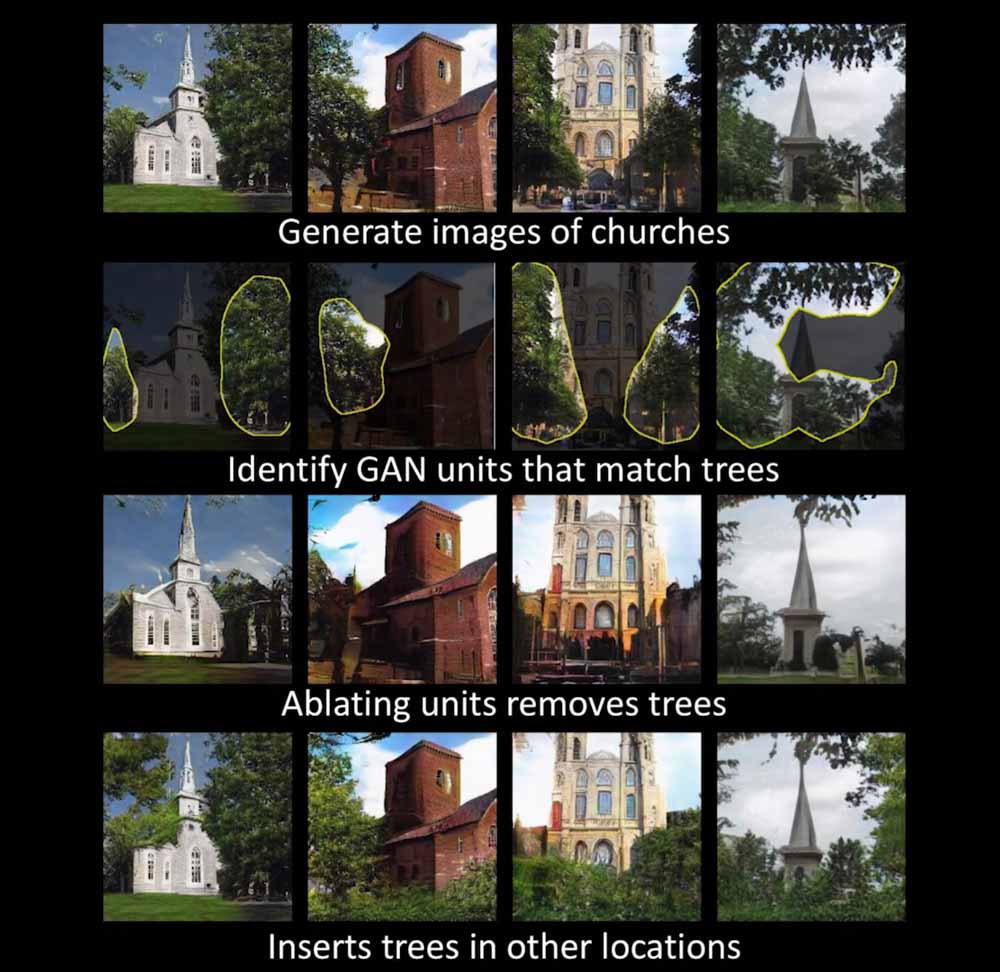

In ihrem Experiment fütterten die Forscher ein GAN mit verschiedenen Landschaftsaufnahmen – allerdings ohne vorgegebene Kategorien. Nach dem Training ließen die Forscher das Netzwerk Bilder generieren und schalteten immer wieder vereinzelte Abschnitte des Netzwerks aus.

Sie stellten fest: Im Netzwerk hatten sich Bereiche gebildet, die bestimmte Motive – zum Beispiel Bäume – repräsentierten. Und das, obwohl diese Bäume Form und Farbe auf jedem Foto änderten.

Das Netzwerk entwickelte Konzepte

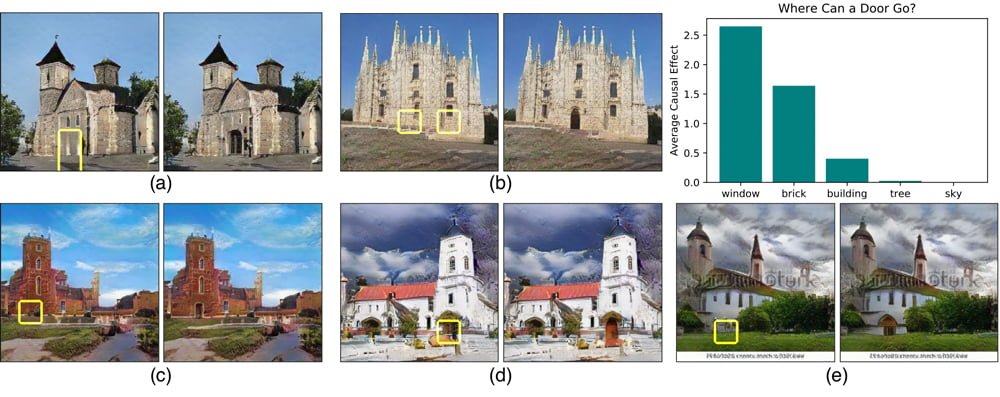

Doch die Fähigkeiten des Netzwerkes gehen darüber hinaus: Es erkennt etwa nicht nur Türen, sondern weigert sich auch, diese in den Himmel zu malen. Schwebende Bäume? Unmöglich.

Es hält sich sogar an architektonische Stile: Gotik-Türen an gotische Gebäude, Georgianische Türen an Georgianische Wände.

Der an der Forschung beteiligte David Bau sieht darin so etwas wie gesunden Menschenverstand. Die Art und Weise, wie das Netzwerk die Welt strukturiere, erinnere „sehr stark an Konzepte, denen Menschen Worte gegeben haben“, so Bau.

Er bezieht sich hier auf den Begriff „Konzept“ aus der Psychologie: Wir teilen die Welt in Bereiche und Gegenstände auf, über die wir gewisse Überzeugungen haben. Beispielsweise über Bäume: Ein Baum ist eine Pflanze, hat üblicherweise einen Stamm, eine Wurzel und eine Krone. Bäume wachsen auf festem Untergrund – es kann also keine schwebenden Bäume geben.

Eine solche Grundvorstellung wird in der Psychologie Konzept genannt. Die Kategorien des Netzwerks und seine Weigerung, schwebende Bäume zu malen, zeigen eine Ähnlichkeit zu unseren Konzepten auf.

Das könnte ein Hinweis darauf sein, dass neuronale Netzwerke die Welt ähnlich strukturieren wie das menschliche Gehirn.

Konzepte lassen sich ansteuern

Die Forscher waren in der Lage, die für die jeweiligen Konzepte zuständigen Netzwerkknoten zu identifizieren und zu kontrollieren. Das erleichterte ihre Forschung - und brachte eine neue App hervor: GANPaint.

GANpaint nutzt die Entdeckung der Forscher als künstlerisches Werkzeug. Durch An- und Abschalten einzelner Netzwerkknoten können Gebäude, Bäume oder Wolken gezeichnet und verändert werden.

Die App integriert die Kontextsensitivität des GANs: Wer Türen in den Himmel malen will, wird enttäuscht vor leerem Firmament stehen.

Die Untersuchung zeigt wieder einmal das gestalterische Potenzial der GA-Netzwerke. Sie vermittelt zugleich ein Verständnis, was im Inneren des Netzwerks vor sich geht. So erreichen die Forscher ihr Ziel: einen kleinen Einblick in die nicht mehr ganz so dunkle Blackbox Künstlicher Intelligenz.