Eine neue Forschungsarbeit zeigt, warum das Training von Robotern eine der größten Herausforderungen in der KI-Entwicklung ist.

KI-Anwendungen verändern unser Leben: Sie analysieren und generieren Bilder, sie erkennen und schreiben Texte, sie identifizieren Muster in Industriedaten, verbessern Wartungsprozesse, steuern Staubsaugerroboter oder erkennen unsere Stimmen und Gesichter.

Ein KI-Szenario soll unsere Welt besonders nachhaltig prägen: eigenständig agierende Roboter. Mit dem richtigen KI-Gehirn ausgestattet, könnten nützliche Multitasking-Roboter Autos fahren, im Haushalt helfen, Industriemüll entsorgen und viele andere Aufgaben übernehmen, die eigentlich wir Menschen erledigen müssten.

Das bestärkende Lernen gilt als vielversprechendste Methode, mit der Roboter diese Fähigkeiten lernen können. Doch der Weg in das Roboterparadies ist steinig, wie eine neue Überblicksstudie von KI-Forschern der Universität Berkeley und Google zeigt.

Ein Dutzend ungelöste Probleme

In ihrer Arbeit fassen die Autoren die Ergebnisse von mehreren Jahren Forschung zusammen. Ihr Fazit: Es gibt mindestens zwölf große Probleme im bestärkenden Lernen (Erklärung) für die Robotik. Könnten diese gelöst werden, führe das zu einem "explosionsartigen Wachstum" bei autonom agierenden Robotern.

"Ich glaube, dass Echtwelt-Aufgaben die größte Herausforderung – aber auch die größte Chance - für das bestärkende Lernen sind", sagt der an der Studie beteiligte Forscher Sergey Levin.

Denn alle großen Erfolge des bestärkenden Lernens fanden bisher im digitalen Raum statt: AlphaGo schlug Go-Großmeister Lee Sedol am Computer-Screen, AlphaZero ist ein digitales Brettspielgenie und MuZero kann zusätzlich auf hohem Niveau Atari-Spiele gewinnen.

Alle KIs wurden digital trainiert und agieren digital. Sie mussten in der Realität keinen einzigen Spielstein verschieben oder Steuerknüppel bewegen.

Für diese Realitätsvermeidung gibt es Gründe: Kürzlich zeigte ein Experiment von Deepmind, dass Algorithmen versagen, sobald sie Spielzüge nicht nur berechnen, sondern zusätzlich auch physisch durchführen müssen - selbst wenn die Physik nur in einem Computerspiel simuliert wird.

Zu den von Levin und seinen Kollegen gefundenen Problemen gehören etwa die fehlende Generalisierung von bestimmten Algorithmen oder die negativen Auswirkungen von Verschleiß, sich ändernde Umgebungsbedingungen und die Abhängigkeit von menschlicher Intervention beim Echtwelt-Training von Robotern.

Die im bestärkenden Lernen eingesetzten Algorithmen sind außerdem notorisch schwer zu trainieren: Schon kleine Änderungen an den zahlreichen Stellschrauben führen zu völlig anderen Ergebnissen.

Darüber hinaus ist die Anzahl möglicher Lösungen für ein Problem in der Robotik so groß, dass dieselben Algorithmen unter denselben Trainingsbedingungen völlig unterschiedlich abschneiden können. Zusammen mit den teils Millionen Trainingsdurchläufen führt das zu einem zeitaufwendigen und besonders in der echten Welt stark eingeschränkten Trainingsprozess.

Sim2Real: Flucht in die Simulation

Als mögliche Lösung gilt das KI-Training in der Simulation. Tatsächlich zeigen sich dort schnelle Trainingsfortschritte, doch die zuverlässige Übertragung auf die echte Welt, die Überwindung der sogenannten Realitätslücke, ist noch immer eine ungelöste Herausforderung.

So könne ein Roboter in der Simulation einen Rückwärtssalto lernen oder Kleidung anziehen – doch in der echten Welt seien grundlegende Laufbewegungen noch immer eine große Herausforderung, schreiben die Forscher.

Die Ursachen für diese Probleme sind vielfältig und reichen von den feinen Unterschieden zwischen der Wahrnehmung in einer Simulation und vergleichbaren Sensordaten in der echten Welt über fehlerhaftes Forschungsdesign bis zu der grundlegenden Herausforderung, passende Belohnungen für Robotik-Aufgaben zu finden.

Die Forscher sehen diese Herausforderungen als Aufgabe zukünftiger Forschung, mit dem Ziel, das Roboterlernen so natürlich und skalierbar wie das biologische Lernen von Menschen und Tieren zu gestalten, bei dem "jedes Verhalten ohne externe Hilfe oder Instrument erlernt werden kann, solange die Aufgabe genau spezifiziert und physikalisch möglich ist und keine unzumutbare Herausforderung darstellt."

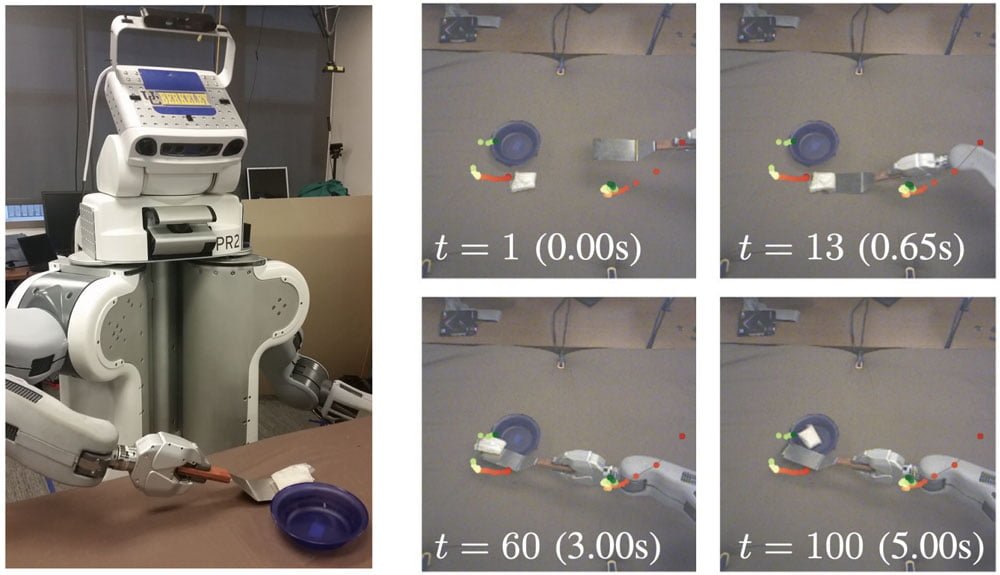

Titelbild: Ibarz et al. (2021) | Via: Arxiv, ZDNet