Wie kann man Künstliche Intelligenz verstehen? Der KI-Forscher Iyad Rawhan fordert eine neue Disziplin, die sich der Erforschung des Verhaltens intelligenter Maschinen widmet.

Neuronale Netze sind die Grundlage moderner Künstlicher Intelligenz. KI moderiert selbstlernend in Social Media, steuert auf Finanzmärkten, lastet Industrieanalagen aus, diagnostiziert in der Medizin oder scannt für die Verbrechensbekämpfung.

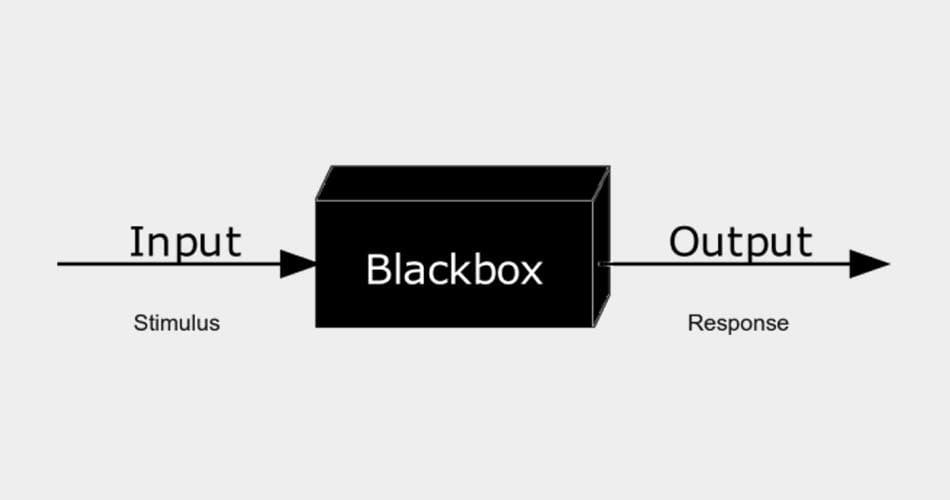

Alle diese Anwendungsszenarien – und viele mehr - haben einen zentralen Makel gemein: Wie genau eine KI zu ihrem Ergebnis gelangt und so in Handlung kommt, ist häufig nicht nachvollziehbar.

Je komplexer die KI, desto schwieriger sind ihre internen Strukturen zu durchschauen. Häufig wird daher von der Blackbox gesprochen: dem schwarzen Kasten, der zwischen Ein- und Ausgabe sitzt, und in den wir nicht hineinschauen können. So ist nicht vorhersehbar, wie sich ein KI-System in freier Wildbahn verhält.

KI-Forscher arbeiten daher an Methoden, mit denen man einen Blick in die Blackbox erhaschen kann. Tech-Unternehmen wie Microsoft, Google, IBM oder Facebook bieten Werkzeuge an, die Entscheidungen von KI-Systemen nachvollziehbar machen sollen.

Gesucht: Interdisziplinäre Maschinenbeobachter

Doch mit diesen Werkzeugen lässt sich wenig über langfristige Auswirkungen Künstlicher Intelligenz in der echten Welt lernen, meint Iyad Rahwan, KI-Forscher und Direktor des Max-Planck-Instituts für Bildungsforschung.

Seine Lösung: das Verhalten intelligenter Maschinen im Einsatz beobachten. "Machine Behaviour" – Maschinenverhalten - tauft Rahwan diese Disziplin.

Das neue Forschungsfeld stellt Rahwan gemeinsam mit 22 Forscherkollegen im Fachmagazin Nature vor, darunter Roboterspezialisten, Evolutionsbiologen, Ökonomen und Anthropologen.

Ähnlich der Verhaltensökologie oder -ökonomik beschäftigt sich das Forschungsfeld Maschinenverhalten mit dem Verhalten eines Akteurs in einer spezifischen Situation.

Die Verhaltensökologie untersucht Wechselwirkungen zwischen dem Verhalten von Lebewesen und den sie umgebenden Umweltfaktoren. Die Verhaltensökonomik untersucht menschliches Verhalten im wirtschaftlichen Kontext. Und Maschinenverhaltensforscher untersuchen das Verhalten intelligenter Maschinen in unserer Gesellschaft.

Insofern erfindet Rahwan kein völlig neues Forschungsfeld, er gibt ihm aber einen Namen. Und mit diesem womöglich eine wissenschaftliche Zukunft mit allem, was diese benötigt: Spezialisierte Forscher, Fachjournale, Finanzierung, neue Methoden und - hoffentlich - Erkenntnisse.

Rahwan betont in seinem Aufsatz, dass Verhalten keinen freien Willen voraussetze. Biologen untersuchten das Verhalten einzelner Zellen, Ökonomen das Verhalten des Marktes. Sein Forschungsfeld müsse also nicht auf eine Super-KI warten. Es sollen selbst einfache KI-Systeme und ihre Wechselwirkungen mit der Gesellschaft betrachtet werden.

Labor vs. Realität

Die Maschinenbeobachter sollen – anders als Entwickler und Ingenieure – nicht auf optimale KI-Performance unter kontrollierten Bedingungen achten. Stattdessen sollen sie KI im Straßenverkehr, in Finanzmärkten, in Polizei- und Rechtsabteilungen, bei der Kriegsführung oder im Online-Dating beobachten.

Wie interagieren KI-Systeme mit Menschen oder anderen Algorithmen? Koordinieren sich autonom gesteuerte Autoflotten auf unvorhergesehene Weise? Wie entwickelt sich ein einfacher Social-Media-Bot im freien Netz?

Konsequenzen einer freigelassenen intelligenten Maschine seien oft nicht vorhersehbar, sagt Rahwan. "Du baust und optimierst die Maschine für eine bestimmte Aufgabe. Aber ihr Verhalten ist ein Aspekt mit offenem Ende, eine unbekannte Größe. Manches Verhalten manifestiert sich über verschiedene Zeiträume. Wenn du dich bei der Entwicklung auf kurzfristiges Verhalten konzentrierst, kannst du das langfristige Verhalten erst erkennen, wenn du die Maschine einsetzt."

Diese Verzögerung führe dazu, dass ein Twitter-Bot rassistisch werde oder Facebooks News-Feed-Algorithmus politische Polarisierung fördere – zwei Verhaltensweisen, die die Erschaffer der Systeme nicht geplant hatten.

Rahwan hofft, dass Maschinenverhaltensforscher bislang unvorhersehbare Auswirkungen vorhersehbar machen und KI-Systeme so verbessern.

Verhaltensbeobachtung soll die großen Fragen beantworten

Maschinenverhaltensforscher sollen also intelligente Maschinen beobachten, verstehen und sie und ihre Interaktion mit uns verbessern. Durch die interdisziplinäre Aufstellung mit einem langfristigen Blick sollen blinde Flecken bei der Beobachtung vermieden werden.

Die Forschung zum Maschinenverhalten soll auch die großen politischen Fragen beantworten: Entwickelt sich KI zu schnell? Sollte sie reguliert werden – und wenn ja, wie?

Die Gesellschaft könne enorme Vorteile aus Künstlicher Intelligenz ziehen, wenn die potenziellen Fallstricke der Integration von KI in den menschlichen Alltag minimiert würden, so Rahwan. Für ihn ist die Erforschung des Maschinenverhaltens gleichbedeutend mit dem Wunsch, von intelligenten Maschinen zu profitieren.

Quellen: Nature, Quanta Magazine