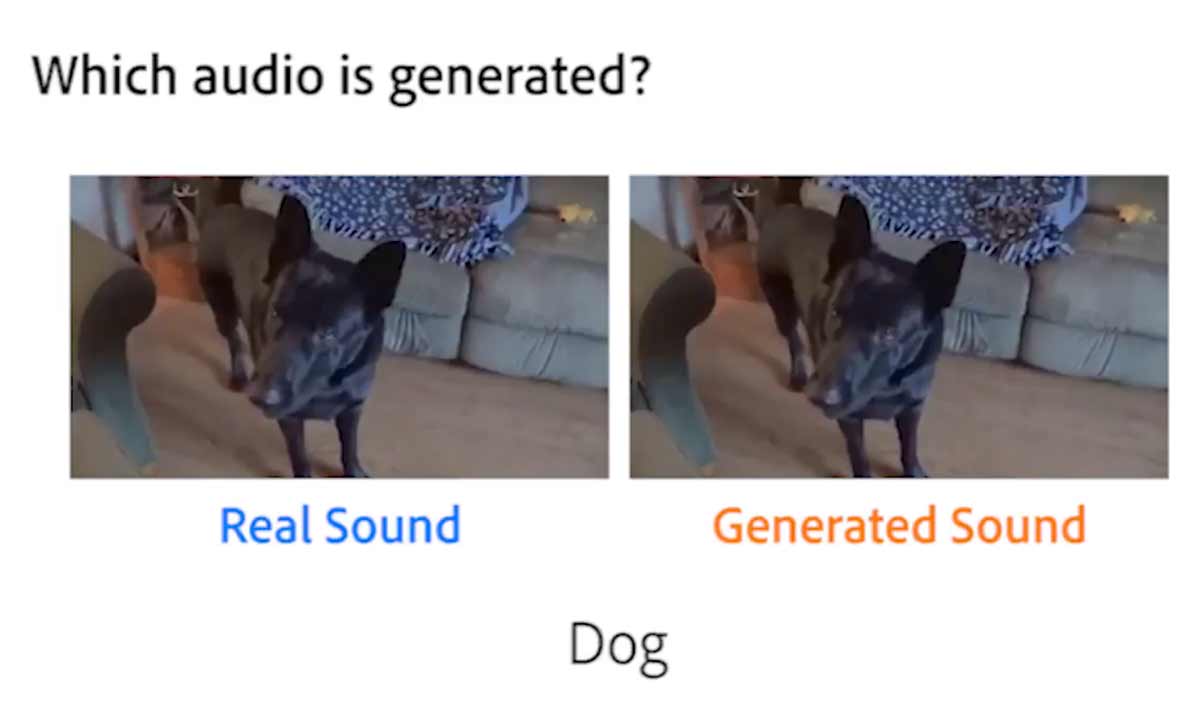

Ein KI-System zeigt einmal mehr, dass wir in Zukunft noch weniger trauen dürfen, was wir in Videos sehen - oder hören. Es legt generierte Töne täuschend echt auf Videos.

In den vergangenen Wochen zeigten unter anderem KI-Forscher von Nvidia, wie eine Künstliche Intelligenz authentisch anmutende Fake-Videos oder -Fotos erstellen kann. In einem Versuch demonstrieren Wissenschaftler der Universität North Carolina at Chapel Hill gemeinsam mit Adobe Research, dass auch glaubhafte Audio-Fälschungen für Videos möglich sind.

Zugrundeliegend war ein Google-Datensatz bestehend aus über zwei Millionen Youtube-Videos sortiert nach Tönen. Diese teilen sich auf in verschiedene Kategorien wie Hunde, Kettensägen, Helikopter und ähnliches. Zehn dieser Kategorien mit insgesamt rund 150.000 Videos wählten die Forscher aus.

Um die Youtube-Daten für die Künstliche Intelligenz verwertbar zu machen, war reichlich menschliche Vorarbeit nötig: Gelegenheitsarbeiter der Amazon Online-Dienstleistungsplattform Mechanical Turk klassifizierten die Töne in den Videos einzeln vorab. Sie mussten deutlich hörbar und die Schallquelle im Video sichtbar sein.

Nach diesem Arbeitsvorgang blieben gut 28.000 Videos mit einer durchschnittlichen Länge von sieben Sekunden übrig. Mit diesen Videos wurde das für Sprachverarbeitung optimierte neuronale Netz SampleRNN trainiert. Es lernte so, zu einem vorgegebenen Video inhaltlich passende Geräusche zu generieren und diese synchron (siehe folgendes Video) auf die Einzelbilder des Videos zu legen. Den zugrundeliegenden Datensatz fürs KI-Training wollen die Wissenschaftler veröffentlichen.

70 Prozent der Fake-Klänge klingen täuschend echt

Das Fazit der Wissenschaftler ist positiv: Die künstlich generierten Klänge seien "recht realistisch" und zeitlich gut mit den Videos synchronisiert. Die Evaluation zeigte, dass die gefälschten Tonaufnahmen von Menschen durchschnittlich in 73 Prozent der Tests als echt klassifiziert wurden. Die realen Tonaufnahmen wurden im Schnitt in rund 91 Prozent der Tests als echt eingeordnet.

Die Forscher schlagen vor, dass mit dem KI-Audioverfahren automatisiert fehlerhafte Sounds in Videos ersetzt oder authentische Klangkulissen für digitale Welten in Virtual Reality erzeugt werden könnten.

Da Adobes Forschungsabteilung in das Experiment involviert ist, scheint die praktische Anwendung auf der Hand zu liegen: Das KI-System könnte beispielsweise in Adobes Video-Software für die Tonbearbeitung integriert werden. Ausführliche Informationen zum Experiment und die Möglichkeit zum Fake-Audio-Selbsttest gibt es auf der offiziellen Webseite.