Forscher zeigen, dass Trainingsdaten von neuronalen Netzen rekonstruiert werden können. Diese Erkenntnis stellt die KI-Branche vor neue Aufgaben bei Datenschutz, Copyright und Sicherheit.

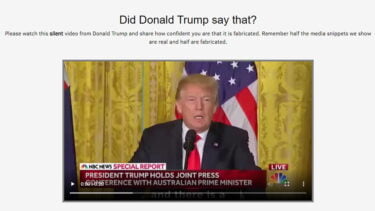

Dank Deepfake-Technik gibt es keinen Mangel mehr an frei verfügbaren Porträtfotos von echt wirkenden Menschen. Sie können per Knopfdruck auf Webseiten wie "This Person does not exist" generiert und dann etwa bei Social Media, in Präsentationen und an vielen anderen Stellen verwendet werden – ohne Bedenken bei Copyright oder Privatsphäre.

Möglich ist das, da die Personen auf den KI-generierten Porträtfotos nicht existieren. Sehr wohl existent sind aber all jene Personen, mit denen das neuronale Netz trainiert wurde, um sich die Fake-Personen auszudenken. In jedem Fake-Porträtbild einer KI stecken also echte Menschen.

Forschende zeigen, dass diese echten Menschen in den Trainingsdaten wiederentdeckt werden können. Dass schließt laut der Forscher auch die Annahme aus, dass es sich bei Fake-Porträts um Originalwerke handeln könnte.

KI-Entscheidungssicherheit lässt Rückschlüsse auf Trainingsdaten zu

In der Studie „This Person (Probably) Exists“ zeigt ein Forschungsteam der Universität Caen, dass sich die Porträt-Trainingsdaten eines Porträtbilder generierenden neuronalen Netzes anhand der Ausgabe rekonstruieren lassen. Grundvoraussetzung ist allerdings der Zugang zum originalen Trainingsdatensatz.

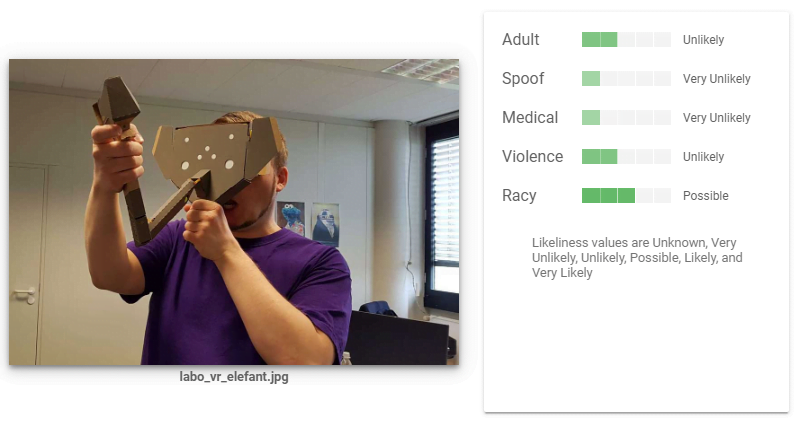

Das Forscherteam nutzte die sogenannte „Zugehörigkeitsattacke“. Ein Beispiel: Ein KI-System kann beschreiben, wie sicher es sich bei der Identifizierung einer Person auf einem Foto ist. Typischerweise identifiziert die KI ein Personenfoto, das in ihrem Trainingsdatensatz enthalten ist, mit einer relativ hohen Sicherheit – sie kennt das Foto bereits aus dem KI-Training und hat es häufig verarbeitet.

Das Bild einer Person außerhalb des Datensatzes, das sie zum ersten Mal sieht, klassifiziert sie womöglich ebenfalls korrekt – aber mit einer geringeren Sicherheit als das schon bekannte Foto aus den Trainingsdaten. Auf Basis dieser variierenden KI-Entscheidungssicherheit kann ein weiterer Algorithmus einschätzen, ob ausgewählte Daten Teil eines Datensatzes sind oder nicht.

Bei medizinischen Diagnose-KIs könnte man so etwa herausfinden, ob eine bestimmte Aufnahme in einem Datensatz einer Krankheit verwendet wurde. Das wiederum ist eine potenzielle Sicherheitslücke.

Welche Personen stecken in einem Deepfake-Porträt?

Die Forscher der Universität Caen erweiterten dieses Vorgehen so, dass sie nicht die exakten Bilder einer Person im Trainingsdatensatz suchten, sondern dem generierten KI-Porträt ähnliche Bilder. Dafür verwendeten sie wiederum eine separate, auf Gesichtserkennung spezialisierte KI, die Ähnlichkeiten zwischen Gesichtern erkennen und den Trainingsdatensatz dahingehend durchsuchen kann.

Auf diese Weise konnten die Forscher bei Tests jene Porträts im Trainingsdatensatz wiederfinden, die der KI wahrscheinlich als Basis für die Generierung eines ausgedachten Porträtbildes dienten, weil sie nach der KI-Einschätzung die gleiche Identität haben.

"Generierte Gesichter können exakte Identitäten sehr genau wiedergeben, auch wenn die Bilder selbst sehr unterschiedlich sind", schreiben die Forscher. Ihr Vorgehen nennen sie "Identitätsbasierte Zugehörigkeitsattacke".

Der Versuch zeigt, dass persönliche und private Daten in trainierten neuronalen Netzen identifizierbar und damit potenziell unsicher sind. Diese Erkenntnis ist nicht auf Fotos begrenzt, auch etwa medizinische Daten könnten so rückwirkend identifiziert werden. Künstler:innen könnten laut Mitautor Ryan Webster mit einer entsprechenden Software per Knopfdruck herausfinden, ob eines ihrer Werke für das Training einer KI verwendet wurde – und möglicherweise Ansprüche am KI-Werk anmelden.

Nvidia wählt den Weg zurück durchs neuronale Netz

Forscher von Nvidia wählten einen alternativen Weg, rückwirkend an die Trainings Input-Daten eines neuronalen Netzes zu gelangen, der ohne Zugang zu den Originaldaten funktioniert.

Dafür unterbrachen sie den generativen Prozess einer KI, die etwa ein Fake-Porträt erstellt, auf halbem Weg und kehrten ihn um. Mit dieser Methode konnten sie Bilder des bekannten ImageNet-Datensatzes akkurat rekonstruieren, wie sie in ihrer Arbeit "Deep Neural Networks are Surprisingly Reversible" beschreiben.

Jan Kautz, bei Nvidia für Lern- und Wahrnehmungsforschung verantwortlich, beschreibt ein Szenario, in dem Angreifer:innen Input-Daten eines KI-Modells rekonstruieren, das zwischen Smartphone und Cloud geteilt wird. Bislang gehe die KI-Gemeinschaft davon aus, dass diese Daten sicher seien, da nur das Modell und nicht die Daten selbst geteilt würden. Durch die demonstrierte Rekonstruktionsmethode ist diese Theorie hinfällig.

Im nächsten Schritt wollen beide Teams auf Basis ihrer Erkenntnisse Methoden entwickeln, die mögliche Attacken abwehren oder unterbinden können.