Eine Gruppe Forscher zeigt einen Algorithmus, der aus einer Handvoll Fotos eine 3D-Szene mit frei beweglicher Perspektive generieren kann - in Echtzeit.

Das zu lösende technische Problem nimmt folgende Gestalt an: Man fotografiert eine statische Szene aus verschiedenen Perspektiven und möchte daraus ein 3D-Abbild erstellen, das eine stufenlose Verschiebung der Perspektive zulässt. Damit das Ergebnis realistisch wirkt, müssen wechselnde Lichtreflexionen mitberechnet werden – eine äußerst komplexe Aufgabe.

Wäre sie gelöst, würden aufwendige Lichtfeldkameras überflüssig. Dies wiederum könnte zur Verbreitung volumetrischer Fotografie führen: 3D-Fotos könnten zu einem Standard werden, von dem sowohl Smartphones als auch VR profitieren würden. Man denke an virtuellen Tourismus, Produktvorschauen oder ganz einfach die Art und Weise, wie Menschen Erinnerungen speichern.

Bewährte Methode mit KI verbessert

Die Forscher des Vidyasirimedhi Institute of Science and Technology in Rayong haben einen Algorithmus mit dem Namen "NeX" entwickelt, der dieser Vision einen großen Schritt näherkommen soll.

NeX beruht auf der MPI-Technik ("Multiplane Image"), bei der ein Lichtfeld in Form mehrerer semitransparenter Tiefenebenen dargestellt wird. Diese Methode hat zwei Nachteile: Sie ist sehr rechenintensiv und gibt komplexe Oberflächenreflexionen nur zum Teil glaubhaft wieder. Die Wissenschaftler wollen mit NeX beide Einschränkungen überwunden haben.

Gelungen ist den Forschern das mit einem speziell auf diese Aufgabe hin trainiertem neuronalen Netz. Die folgenden Beispielvideos zeigen das Ergebnis. Im Vergleich mit früheren Methoden der 3D-Bildsynthese sollen Lichtreflexionen realistischer simuliert werden und das Bild insgesamt schärfer sein.

NeX und SNeRG: Schneller und besser als frühere Verfahren

NeX soll etwa 1000 Mal effizienter arbeiten als bisherige Systeme und eine Echtzeit-Wiedergabe mit hohen Bildwiederholraten ermöglichen. Allerdings benötigt man dafür noch immer starke Hardware.

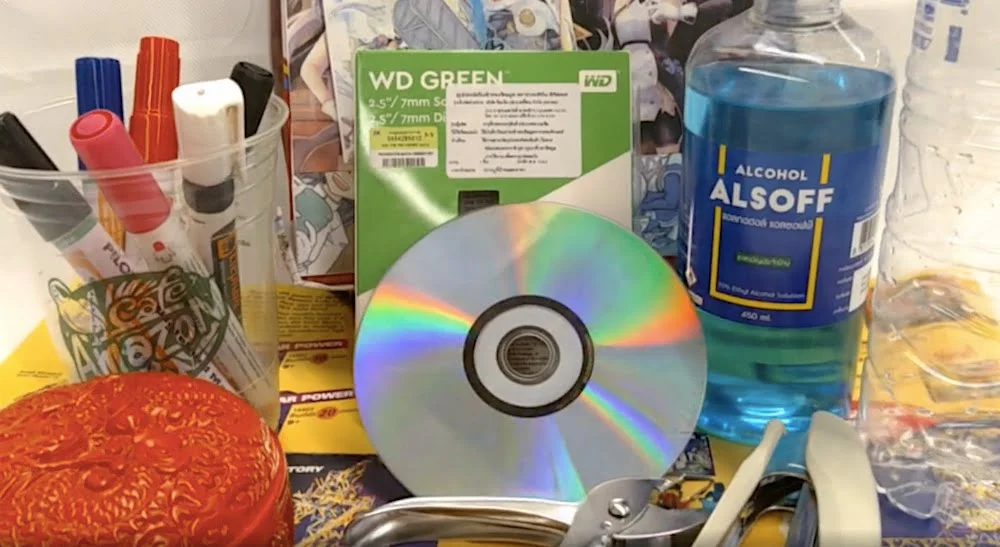

Ein 3D-Foto, das auf Basis von 17 Bildern generiert wird, läuft auf einer Nvidia RTX 2080 Ti mit 300 Bildern pro Sekunde. Eine frühere Methode benötigte mit der gleichen Computerleistung knapp eine Minute, um ein einzelnes Bild zu berechnen.

Auch Google macht Fortschritte in diesem Gebiet und stellte im Frühjahr mit SNeRG eine Lösung vor, die auf einem MacBook Pro läuft. Die thailändischen Forscher gehen in ihrer Forschungsarbeit nicht auf Googles Ansatz ein.

Techdemos selbst ausprobieren

Auf der offiziellen Internetseite des Forschungsprojekts kann man das NeX Echtzeit-Rendering testen – auf Smartphones, PCs oder PC-VR-Brillen mit WebXR-kompatiblem Browser. Dort kann man auch die Forschungsarbeit herunterladen.

Trotz dieser Fortschritte gibt es noch Hürden. Eine große Einschränkung der MPI-Technik gilt nämlich auch für NeX: Bewegt sich der Blick zu weit vom Bildzentrum weg, entstehen Artefakte und die 3D-Illusion zerbricht. Zudem ist der KI-Algorithmus in anspruchsvollen Szenen überfordert und erzielt kein täuschend echtes Ergebnis.

In ihrem Fazit schlussfolgern die Forscher, dass ihre KI-Methode weiter verbessert und in Zukunft auf andere Techniken als MPI übertragen werden kann.

Das Potenzial von volumetrischen Aufnahmen für VR zeigt Googles Gratis-Techdemo Welcome to Lightfields für PC-VR-Brillen (Vergleich).